App installieren

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Anmerkung: This feature may not be available in some browsers.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Artikel Neuer Artikel: Bobcat, das Bulldözerchen

- Ersteller Nero24

- Erstellt am

Opteron

Redaktion

☆☆☆☆☆☆

Mit dem Ethernetanschluss würde die Bandbreite dann besser werden ?Von Weglassen war keine Rede. Das Design wirkt auf mich nur nicht sehr effizient, wenn man in Relation die geringe Bandbreite heranzieht.

Irgendwie steh ich wohl gerade auf den Schlauch, was Du sagen willst ^^

G

Gast29012019_2

Guest

Hätten der Chip eDRAM integriert, wüssten wir sicher schon davon. Dasselbe gilt für die weiter oben erwähnte AES Einheit.

Wozu wenn man das gleich da haben kann wo man es braucht, z.b als Hardware in einer Festplatte, die man heute schon kaufen kann. 8)

OBrian

Moderation MBDB, ,

- Mitglied seit

- 16.10.2000

- Beiträge

- 17.033

- Renomée

- 267

- Standort

- NRW

- Details zu meinem Desktop

- Prozessor

- Phenom II X4 940 BE, C2-Stepping (undervolted)

- Mainboard

- Gigabyte GA-MA69G-S3H (BIOS F7)

- Kühlung

- Noctua NH-U12F

- Speicher

- 4 GB DDR2-800 ADATA/OCZ

- Grafikprozessor

- Radeon HD 5850

- Display

- NEC MultiSync 24WMGX³

- SSD

- Samsung 840 Evo 256 GB

- HDD

- WD Caviar Green 2 TB (WD20EARX)

- Optisches Laufwerk

- Samsung SH-S183L

- Soundkarte

- Creative X-Fi EM mit YouP-PAX-Treibern, Headset: Sennheiser PC350

- Gehäuse

- Coolermaster Stacker, 120mm-Lüfter ersetzt durch Scythe S-Flex, zusätzliche Staubfilter

- Netzteil

- BeQuiet 500W PCGH-Edition

- Betriebssystem

- Windows 7 x64

- Webbrowser

- Firefox

- Verschiedenes

- Tastatur: Zowie Celeritas Caseking-Mod (weiße Tasten)

Er meint, die GPU sei zu groß, die verfügbare Bandbreite des System-RAMs reiche nur für eine kleinere GPU. So würde ich das aber auch nicht sehen. Die Radeons sind sowieso bereits ziemlich effizient und sparsam in der Nutzung der RAM-Bandbreite, und es soll die Latenz verringert worden sein, was ja auch immer die effektiv nutzbare Bandbreite verbessert (wie wir schon damals bei K7 zu K8 gesehen haben). Und wenn grafikfremde Berechnungen angestellt werden mit komplexen Shaderprogrammen, dann sind ein paar mehr Shader wohl sinnvoll, auch ohne mehr RAM-Bandbreite.Mit dem Ethernetanschluss würde die Bandbreite dann besser werden ?

Irgendwie steh ich wohl gerade auf den Schlauch, was Du sagen willst ^^

Die meiste Fläche im GPU-Bereich geht auch sicher nicht nur für die Shader drauf, auch z.B. der UVD ist relativ groß. Die Shaderanzahl z.B. zu halbieren würde die GPU sicher nicht sehr stark in der Fläche verringern.

Ein integrierter Ethernetcontroller wäre sicher nett, allerdings werden Ontario-Systeme in den meisten Fällen hochmobil sein, d.h. Netbooks, Tablets usw., und da macht ein WLAN mehr Sinn, ein Ethernetkabel werden wohl die wenigsten Nutzer anschließen. AMD hat sich sicher bewußt auf die Dinge beschränkt, die wirklich auch von den meisten Leuten genutzt und benötigt werden, eine übermäßig komplexe eierlegende Wollmilchsau würde den Stromverbrauch und die Diefläche zu groß werden lassen.

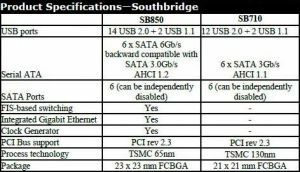

Es kann auch einfach sein, daß AMD noch zu große technische Probleme mit integrierten Ethernetcontrollern hat, immerhin haben sie bisher nie einen gebaut, bis zur neuen SB850, aber der wird auch von keinem einzigen Boardhersteller genutzt, möglicherweise weil er nicht oder nur unbefriedigend funktioniert.

Bobo_Oberon

Grand Admiral Special

- Mitglied seit

- 18.01.2007

- Beiträge

- 5.045

- Renomée

- 190

Oder kein Mainboard-Hersteller keinen Bock hat die notwendige teure Broadcom PHY dazu zu kaufen.... Es kann auch einfach sein, daß AMD noch zu große technische Probleme mit integrierten Ethernetcontrollern hat, immerhin haben sie bisher nie einen gebaut, bis zur neuen SB850, aber der wird auch von keinem einzigen Boardhersteller genutzt, möglicherweise weil er nicht oder nur unbefriedigend funktioniert.

Und Broadcom kann ziemlich sicher derartige Ethernetcontroller bauen, sonst hätte AMD das ja nicht den MAC-Controller lizenziert und implementiert: "Warum keiner den Netzwerk-Controller der AMD SB850 nutzt".

MFG Bobo(2010)

G

Gast29012019_2

Guest

Neu ist das Problem nicht, um die Kosten für einen CSA angebundenen Intel Lan Chip zu sparen, haben viele Hersteller auf Realtek PCI etc gesetzt, beim damaligen I-875P Chipsatz.

AMD könnte dies ja ändern, und sich einen anderen Hersteller suchen z.b Atheros, Marvell, Realtek um Kosten zu sparen oder selbst ein Lan-Chip entwickeln und den nutzen. Irgendwie hat da jeder Hersteller was eigenes bloß AMD nicht. Oder einfach weglassen, wozu Geld an Marvell abdrücken wenn das Feature eh keiner nutzt. Aber man kann davon ausgehen das AMD nicht auf den Kopf gefallen ist, und bei dem 9xx Chipsatz incl. neuer SB der Teil geändert wird oder komplett verschwindet, letztlich kann ja egal sein welcher Lan-Chip sich auf dem Board befindet, solange er per PCIe angebunden ist.

AMD könnte dies ja ändern, und sich einen anderen Hersteller suchen z.b Atheros, Marvell, Realtek um Kosten zu sparen oder selbst ein Lan-Chip entwickeln und den nutzen. Irgendwie hat da jeder Hersteller was eigenes bloß AMD nicht. Oder einfach weglassen, wozu Geld an Marvell abdrücken wenn das Feature eh keiner nutzt. Aber man kann davon ausgehen das AMD nicht auf den Kopf gefallen ist, und bei dem 9xx Chipsatz incl. neuer SB der Teil geändert wird oder komplett verschwindet, letztlich kann ja egal sein welcher Lan-Chip sich auf dem Board befindet, solange er per PCIe angebunden ist.

Zuletzt bearbeitet:

SPINA

Grand Admiral Special

- Mitglied seit

- 07.12.2003

- Beiträge

- 18.122

- Renomée

- 985

- Mein Laptop

- Lenovo IdeaPad Gaming 3 (15ARH05-82EY003NGE)

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 3700X

- Mainboard

- ASUS PRIME X370-PRO

- Kühlung

- AMD Wraith Prism

- Speicher

- 2x Micron 32GB PC4-25600E (MTA18ASF4G72AZ-3G2R)

- Grafikprozessor

- Sapphire Pulse Radeon RX 7600 8GB

- Display

- LG Electronics 27UD58P-B

- SSD

- Samsung 980 PRO (MZ-V8P1T0CW)

- HDD

- 2x Samsung 870 QVO (MZ-77Q2T0BW)

- Optisches Laufwerk

- HL Data Storage BH16NS55

- Gehäuse

- Lian Li PC-7NB

- Netzteil

- Seasonic PRIME Gold 650W

- Betriebssystem

- Debian 12.x (x86-64)

- Verschiedenes

- ASUS TPM-M R2.0

Wobei sich die Frage stellt, warum es überhaupt kein Hersteller tut. Nicht einer. Beim Intel PCH55 oder ICH10R kommt es durchaus vereinzelt vor.Oder kein Mainboard-Hersteller keinen Bock hat die notwendige teure Broadcom PHY dazu zu kaufen.

Und ich bezweifle jetzt, dass die Broadcom PHY wesentlich teurer ist als eine Intel. Da müsste sie doch wenigstens bei den Flaggschiffen zu finden sein.

G

Gast29012019_2

Guest

Das wissen nur die Mobo Hersteller selbst, wenn im Bereich bis 200 Euro für ein "Premium" Board geht, und dann das Geld für son popeligen PHY nicht reicht. Simpel und einfach wäre auch das man ein bestimmtes Boardlayout verwendet, was nicht vorsieht das der Lan On-Board genutzt wird.

Opteron

Redaktion

☆☆☆☆☆☆

Oder kein Mainboard-Hersteller keinen Bock hat die notwendige teure Broadcom PHY dazu zu kaufen.

Jo genau, die Story ... da fällt mir dann wieder das K.O. Kriterium gegen onboard Ethernet ein: Für die MAC braucht man auch nen schnellen Anschluss, irgendwas ähnliches wie PCIe.

Aber dann kann man halt gleich einen echten PCIe anflanschen und es den OEMs überlassen, ob sie nen Realtek Ethernet, WLAN oder sonstwas dranbauen. Ein extra Kontroller würde da sicher nur stören, DIE Fläche & Strom verbrachen, und dann doch nicht genutzt werden ^^

Also sagen wirs mal so: Ich vermisse da nichts ...

Zur SB850: Wie schauts da bei den Serverbrettern aus, gibts vielleicht wenigstens da mal jemanden ders nützt (auch wenn die SB850 da anders heißt ^^) ?

ciao

Alex

Bobo_Oberon

Grand Admiral Special

- Mitglied seit

- 18.01.2007

- Beiträge

- 5.045

- Renomée

- 190

TYAN S8005 (S8005WAGM2NR ) AMD SR5670 + AMD SP5100 (Southbridge) nutzt NICHT die Broadcom-Lösung (PDF).... Zur SB850: Wie schauts da bei den Serverbrettern aus, gibts vielleicht wenigstens da mal jemanden ders nützt (auch wenn die SB850 da anders heißt ^^) ?

TYAN S8212 (S8212GM3NR) AMD SR5690 + AMD SP5100 (Southbridge) nutzt NICHT die Broadcom-Lösung (PDF).

TYAN S8208 (S8208GM2NR [BTO]) AMD SR5650 + AMD SP5100 (Southbridge) nutzt NICHT die Broadcom-Lösung (PDF).

Ich habe bei Tyan und Supermicro nicht genauer gesucht ... aber wenns schon da nicht genutzt wird ... und da sind sogar Intels Netzwerkchips drauf.

MFG Bobo(2010)

Opteron

Redaktion

☆☆☆☆☆☆

Da fällt mir gerade wieder ein war die SP5100 vielleicht noch die SB750 .. bin mir gerade nicht sicher. Zumindest die mittlerweile alten Socket-F Istanbul Bretter waren zu früh für die SB850 fertig, wenn dann müßte man wohl bei den nagelneuen G34/C32 Teilen schauen.

Edit:

Hab ich mal bei Tyan gemacht, alles nachwievor nur mit SP5100 .. und demzufolge Intel LAN Chips

Da muss man wohl noch weiter warten.

ciao

Alex

Edit:

Hab ich mal bei Tyan gemacht, alles nachwievor nur mit SP5100 .. und demzufolge Intel LAN Chips

Da muss man wohl noch weiter warten.

ciao

Alex

SPINA

Grand Admiral Special

- Mitglied seit

- 07.12.2003

- Beiträge

- 18.122

- Renomée

- 985

- Mein Laptop

- Lenovo IdeaPad Gaming 3 (15ARH05-82EY003NGE)

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 3700X

- Mainboard

- ASUS PRIME X370-PRO

- Kühlung

- AMD Wraith Prism

- Speicher

- 2x Micron 32GB PC4-25600E (MTA18ASF4G72AZ-3G2R)

- Grafikprozessor

- Sapphire Pulse Radeon RX 7600 8GB

- Display

- LG Electronics 27UD58P-B

- SSD

- Samsung 980 PRO (MZ-V8P1T0CW)

- HDD

- 2x Samsung 870 QVO (MZ-77Q2T0BW)

- Optisches Laufwerk

- HL Data Storage BH16NS55

- Gehäuse

- Lian Li PC-7NB

- Netzteil

- Seasonic PRIME Gold 650W

- Betriebssystem

- Debian 12.x (x86-64)

- Verschiedenes

- ASUS TPM-M R2.0

Wenigstens haben meine nVidia GeForce 8300 mGPU (ASUS M3N78 PRO) und nForce 750a SLI (ASUS M3N72-D) Boards alle RTL8211C PHYs.

Etwas ärgerlich ist es schon, wenn der Chipsatz bei AMD so etwas anbietet und es dann brachliegt. Schon allein wenn man an die Treiber denkt.

Etwas ärgerlich ist es schon, wenn der Chipsatz bei AMD so etwas anbietet und es dann brachliegt. Schon allein wenn man an die Treiber denkt.

Wieso wird beim Auto-Layout Platz verschwendet? Als Ahnungsloser würde ich bei computergenerierten Designs eher an chaotische Strukturen ohne logischen Zusammenhang denken, die kein Mensch durchblickt aber doch in Summe weniger Platz verbrauchen. Hätte eher beim "menschlichen" Design auf Platzverschwendung auf Grund besserer "Durchschaubarkeit" (Einteilung in logische, rechteckige Bereiche) getippt.

jo hab ich mir auch gedacht kann mich mal bitte einer aufklären der ahnung hat?

Opteron

Redaktion

☆☆☆☆☆☆

Zitat von The G

Wieso wird beim Auto-Layout Platz verschwendet? Als Ahnungsloser würde ich bei computergenerierten Designs eher an chaotische Strukturen ohne logischen Zusammenhang denken, die kein Mensch durchblickt aber doch in Summe weniger Platz verbrauchen. Hätte eher beim "menschlichen" Design auf Platzverschwendung auf Grund besserer "Durchschaubarkeit" (Einteilung in logische, rechteckige Bereiche) getippt.

jo hab ich mir auch gedacht kann mich mal bitte einer aufklären der ahnung hat?

Schaut mal auf die Transistorenzahl, da sind wir im 3stelligen Millionenbereich.

Wenn ein Softwareprogramm das besser als ein Mensch hinbekäme, dann würden wir schon längt von künstlicher Intelligenz beherrscht werden

Kurz: Da sind verdammt viel Kompromisse, mit noch mehr Seiteneffekten nötig, die Mensch immer noch besser hinbekommt als Maschine.

Dr@

Grand Admiral Special

- Mitglied seit

- 19.05.2009

- Beiträge

- 12.791

- Renomée

- 4.066

- Standort

- Baden-Württemberg

- Aktuelle Projekte

- Collatz Conjecture

- Meine Systeme

- Zacate E-350 APU

- BOINC-Statistiken

- Mein Laptop

- FSC Lifebook S2110, HP Pavilion dm3-1010eg

- Details zu meinem Laptop

- Prozessor

- Turion 64 MT37, Neo X2 L335, E-350

- Mainboard

- E35M1-I DELUXE

- Speicher

- 2x1 GiB DDR-333, 2x2 GiB DDR2-800, 2x2 GiB DDR3-1333

- Grafikprozessor

- RADEON XPRESS 200m, HD 3200, HD 4330, HD 6310

- Display

- 13,3", 13,3" , Dell UltraSharp U2311H

- HDD

- 100 GB, 320 GB, 120 GB +500 GB

- Optisches Laufwerk

- DVD-Brenner

- Betriebssystem

- WinXP SP3, Vista SP2, Win7 SP1 64-bit

- Webbrowser

- Firefox 13

kann keine SB 850 sein, da die 5100er kein SATA 3 hat

G

Gast29012019_2

Guest

Das der Servermarkt da quasi sich noch in der Steinzeit befindet, ist ja nicht neu. Bis da mal was neues kommt, bzw. mal Altlasten abgeschafft werden vergeht eine sehr lange Zeit. Aber ich denke in 2011 kann man auch da dann mit SATA-3 und USB 3.0 rechnen, vorher vermutlich nicht. Aber man kann ebend nicht alles erwarten, in meinen Augen ist die Serverschiene nunmal eine Schnecke was die Integration von neuen Features und weglassen von Altlasten angeht. Auf der anderen Seite gehts mir beim Desktop zu schnell, die Zeiten wo man neue Hardware braucht verkürzen sich laufend.

Zuletzt bearbeitet:

[P3D] Crazy_Chris

Grand Admiral Special

- Mitglied seit

- 11.11.2001

- Beiträge

- 9.451

- Renomée

- 116

- Mein Laptop

- Sony Vaio VPC-CW2S1E/R (14,1", Core i3 330M, GeForce GT 330M, Intel X25-M G2 80 GB)

- Details zu meinem Desktop

- Prozessor

- Intel Core i5-750 @ 3.36Ghz (1,18V)

- Mainboard

- Gigabyte GA-P55M-UD2

- Kühlung

- Scythe Mugen 2 Rev. B

- Speicher

- 4x 2GB G.Skill F3-12800CL9D-4GBNQ (DDR3-1600)

- Grafikprozessor

- Gigabyte GV-N570OC-13I (GeForce GTX 570 OC 1280MB GDDR5)

- Display

- Dell UltraSharp 2407WFP

- HDD

- Crucial RealSSD C300 128 GB, Samsung SpinPoint F3 1TB

- Optisches Laufwerk

- LG GGC-H20L SATA *Blu-ray*

- Soundkarte

- Creative Sound Blaster X-Fi Titanium PCIe

- Gehäuse

- Silverstone Temjin TJ08 µATX

- Netzteil

- ELVT NesteQ NA4501 (450 W, Semipassiv)

- Betriebssystem

- Windows 7 und Ubuntu (x64)

- Webbrowser

- Mozilla Firefox

- Verschiedenes

- guckguck :-P

Die TDP Angaben des Atom bezieht sich wohl auf die Desktopvarianten. Ein aktueller Atom N550 wie er in Notebooks verbaut wird hat eine TDP von 8,5W (2 Cores 1,5Ghz) Die Singlecorevariante liegt bei 5,5W. Ich glaube eher das sich Bobcat damit messen lassen muß. In Netbooks werden die stromfressenden Atom D Varianten nicht verbaut.

Ich glaube der eigentliche Gegner könnte eher Core 2 Duo SU7300 und Konsorten heißen. Passt von der Leistung und der TDP viel eher zum Bobcat.

Ich werd gleich mal aufbrechen und mir Bobcat in Aktion auf der IFA anschauen.

Ich glaube der eigentliche Gegner könnte eher Core 2 Duo SU7300 und Konsorten heißen. Passt von der Leistung und der TDP viel eher zum Bobcat.

Ich werd gleich mal aufbrechen und mir Bobcat in Aktion auf der IFA anschauen.

Zuletzt bearbeitet:

Bobo_Oberon

Grand Admiral Special

- Mitglied seit

- 18.01.2007

- Beiträge

- 5.045

- Renomée

- 190

Jo, danke. Die Postings von Opteron berichtet ja schon darüber. Der Zeitpunkt des Starts der Serverchipsätze hatte mich da etwas zögern lassen - fragt sich nun in wie weit Tyan, Supermicro und Konsorten auf die 850 Southbridge schon gewechselt sind.kann keine SB 850 sein, da die 5100er kein SATA 3 hat

MFG Bobo(2010)

Ragas

Grand Admiral Special

- Mitglied seit

- 24.05.2005

- Beiträge

- 4.470

- Renomée

- 85

- Details zu meinem Desktop

- Prozessor

- AMD Athlon 64 X2 3800+ @2520MHz; 1,4V; 53°C

- Mainboard

- Asus A8N-E

- Kühlung

- Thermaltake Sonic Tower (doppelt belüftet)

- Speicher

- 4x Infineon DDR400 512MB @207MHz

- Grafikprozessor

- Nvidia GeForce FX 7800GT

- Display

- 1.: 24", Samsung SyncMaster 2443BW, 1920x1200 TFT 2.: 19", Schneider, 1280x1024 CRT

- HDD

- Seagate Sata1 200GB 7200rpm, 2x250GB Seagate SATA2 im Raid0

- Optisches Laufwerk

- DVDBrenner LG GSA 4167

- Soundkarte

- Creative X-Fi Extreme Music

- Gehäuse

- Thermaltake Soprano Silber

- Netzteil

- Be-quiet! Darkpower 470W

- Betriebssystem

- Windows XP; Linux Mandriva 2007.1 (Kernel: 2.6.22.2 Ragas-Edition :D )

- Webbrowser

- Firefox

- Verschiedenes

- -Lüftersteuerung: Aerogate3

Wieso wird beim Auto-Layout Platz verschwendet? Als Ahnungsloser würde ich bei computergenerierten Designs eher an chaotische Strukturen ohne logischen Zusammenhang denken, die kein Mensch durchblickt aber doch in Summe weniger Platz verbrauchen. Hätte eher beim "menschlichen" Design auf Platzverschwendung auf Grund besserer "Durchschaubarkeit" (Einteilung in logische, rechteckige Bereiche) getippt.

Das liegt daran, dass ein Mensch generell intelligent agieren kann. Der Computer folgt beim Design nur vorgegebenen Regeln, die in bestimmten Situationen auch suboptimal sein können (was ein Mensch aber erkennen könnte).

Bobo_Oberon

Grand Admiral Special

- Mitglied seit

- 18.01.2007

- Beiträge

- 5.045

- Renomée

- 190

Im Artikel ist sogar ein Direktlink zu Intels Pineview enthalten[P3D] Crazy_Chris;4286617 schrieb:Die TDP Angaben des Atom bezieht sich wohl auf die Desktopvarianten. Ein aktueller Atom N550 wie er in Notebooks verbaut wird hat eine TDP von 8,5W (2 Cores 1,5Ghz) Die Singlecorevariante liegt bei 5,5W ...

MFG Bobo(2010)

Opteron

Redaktion

☆☆☆☆☆☆

Im Artikel ist sogar ein Direktlink zu Intels Pineview enthalten

Jo, aber er hat recht, das N550 Teil ist neu, Intel news vom 23.8:

http://newsroom.intel.com/community...oks-hit-shelves-today?cid=rss-90004-c1-258388

Featureübersicht:

http://ark.intel.com/Product.aspx?id=50154&code=Intel%C2%AE+Atom%E2%84%A2+Processor+N550+%281M+Cache%2c+1.50+GHz%29

Aber das ändert nichts an der Aussage, nachdem Ontario mit 9W ja jetzt auch dual core ist.

Der N550 taktet nur mit 1,5GHz, das ist nicht die Welt und Intel will $86 dafür, sollte mit Ontario ebenfalls zu schaffen sein. Selbst wenns nur ~1,2 GHz für Ontario werden würde, sollte der IPC Vorteil immer noch zu spüren sein. Dabei ist die GPU wieder mal gar nicht erst erwähnt

ciao

Alex

Bobo_Oberon

Grand Admiral Special

- Mitglied seit

- 18.01.2007

- Beiträge

- 5.045

- Renomée

- 190

Google mal unter Apple A4+Die. Oder alternativ Texas Instruments OMAP44x+SoC+Die Womöglich wird dann was brauchbares bei rauskommen.Wie groß ist eigentlich ein ARM Cortex A8 und A9 - Core im Vergleich zu ATOM bzw. Bobcat.

Bzw. wie groß ist auch der Performance & Stromverbrauchs-Unterschied??

Bei GlobalFoundries und/oder ARM direkt wird sicher auch was dabei sein.

Nachtrag:

"ARM Cortex-A9: Entweder schnell oder sparsam".... eine beiden Kerne (A9 MPCore) verheizen dabei 1,9 Watt und belegen 6,7 Quadratmillimeter Chipfläche. Das andere kommt mit 4,9 mm² und 0,5 Watt aus ...

"ARM: Nachwuchs für die die Cortex-A-Familie".... Cortex-A5 nur ein Zehntel der Chipfläche von Intels Atom belegt. Außerdem käme er mit einem Zehntel der elektrischen Leistung aus ...

MFG Bobo(2010)

Zuletzt bearbeitet:

The G

Lt. Commander

- Mitglied seit

- 22.04.2008

- Beiträge

- 128

- Renomée

- 2

- Standort

- Das schöne Allgäu

- Details zu meinem Desktop

- Prozessor

- AMD Phenom II 965 C3 @ 3,8GHz

- Mainboard

- MSI 790GX-G65

- Kühlung

- EKL Nordwand

- Grafikprozessor

- Sapphire 3870

- Display

- LG W2442PA @ 1920x1080

- HDD

- Samsung Spinpoint F1 & F3

- Soundkarte

- Creative Sound Blaster X-FI Titanium

- Gehäuse

- Lancool K62

- Netzteil

- Arctic Cooling Fusion 550R

- Betriebssystem

- Windows 7 Ultimate 64bit

- Webbrowser

- Firefox

Gerade bei solch hohen Summen würde ich keinem Menschen zutrauen das besser zu können als ein Computer. Aber das der Knackpunkt darin liegt passende Regeln für die Software zu definieren die alle Bedingungen und Seiteneffekte optimal abbilden, damit kann ich lebenSchaut mal auf die Transistorenzahl, da sind wir im 3stelligen Millionenbereich.

Wenn ein Softwareprogramm das besser als ein Mensch hinbekäme, dann würden wir schon längt von künstlicher Intelligenz beherrscht werden

Opteron

Redaktion

☆☆☆☆☆☆

Das gehts schon per Divide und Conquer. Hab wegen des Artikels irgendwo gelesen, dass z.B: auch die Atom Mannschaft in unterschiedliche Teams unterteilt war, die sich jeweils die einzelnen Kompononeten vornahmen, FPU, IMC, BusUnit, etc.pp.Gerade bei solch hohen Summen würde ich keinem Menschen zutrauen das besser zu können als ein Computer. Aber das der Knackpunkt darin liegt passende Regeln für die Software zu definieren die alle Bedingungen und Seiteneffekte optimal abbilden, damit kann ich leben

Und das allein schon beim Atom ..

Da ist klar, welchen Kaliber Bulldozer oder Sandy Bridge haben

[P3D] Crazy_Chris

Grand Admiral Special

- Mitglied seit

- 11.11.2001

- Beiträge

- 9.451

- Renomée

- 116

- Mein Laptop

- Sony Vaio VPC-CW2S1E/R (14,1", Core i3 330M, GeForce GT 330M, Intel X25-M G2 80 GB)

- Details zu meinem Desktop

- Prozessor

- Intel Core i5-750 @ 3.36Ghz (1,18V)

- Mainboard

- Gigabyte GA-P55M-UD2

- Kühlung

- Scythe Mugen 2 Rev. B

- Speicher

- 4x 2GB G.Skill F3-12800CL9D-4GBNQ (DDR3-1600)

- Grafikprozessor

- Gigabyte GV-N570OC-13I (GeForce GTX 570 OC 1280MB GDDR5)

- Display

- Dell UltraSharp 2407WFP

- HDD

- Crucial RealSSD C300 128 GB, Samsung SpinPoint F3 1TB

- Optisches Laufwerk

- LG GGC-H20L SATA *Blu-ray*

- Soundkarte

- Creative Sound Blaster X-Fi Titanium PCIe

- Gehäuse

- Silverstone Temjin TJ08 µATX

- Netzteil

- ELVT NesteQ NA4501 (450 W, Semipassiv)

- Betriebssystem

- Windows 7 und Ubuntu (x64)

- Webbrowser

- Mozilla Firefox

- Verschiedenes

- guckguck :-P

Im Artikel ist sogar ein Direktlink zu Intels Pineview enthalten

MFG Bobo(2010)

Hatte ich gesehen. Nur ignoriert der Artikel den N550 der ja ein besseres Leistung pro Watt Verhältnis hat. Das Bobcat wohl um einiges schneller und vor allem eine brauchbare Grafik hat sollte klar sein aber sparsamer als ein moderner Atom wird er sicher nicht. Kann sogar passieren das er später gegen ein 32nm Atom antreten muss der sicher nicht nur mit 1,66Ghz läuft. Ich glaub nicht das Intel sich nicht darauf vorbereitet. Immerhin ist es sicher ein sehr lukrativer Markt wenn man sich die Preise und DIE Größen anschaut.

PS: IFA war nen totaler Reinfall was AMD betrifft. Überall nur Vision und der Stand bestand nur aus 10-15 Notebooks. (wie an jeden 2. Stand wurde natürlich Dirt 2 gespielt

) Der ganze Stand war in "ATi-Rot" und wenn AMD nicht dagestanden hätte so hätte das keiner geglaubt.

) Der ganze Stand war in "ATi-Rot" und wenn AMD nicht dagestanden hätte so hätte das keiner geglaubt. Aber wenigstens konnte man Haribo Frösche powered by AMD abstauben.

8)

8)

Zuletzt bearbeitet:

Ähnliche Themen

- Antworten

- 0

- Aufrufe

- 931

- Antworten

- 728

- Aufrufe

- 50K

- Antworten

- 16

- Aufrufe

- 5K

- Antworten

- 34

- Aufrufe

- 10K