App installieren

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Anmerkung: This feature may not be available in some browsers.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

E555user

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 05.10.2015

- Beiträge

- 2.175

- Renomée

- 938

Die Hölle friert zu: AMD bringt einen Compiler

für AI als Open Source ...

...allerdings handelt es sich bei Peano LLVM um ein Xilinx-Projekt und es ist deshalb vielleicht nicht mehr ganz so revolutionär.

PCMasters.de hat einen wie ich finde sehr guten Artikel dazu:

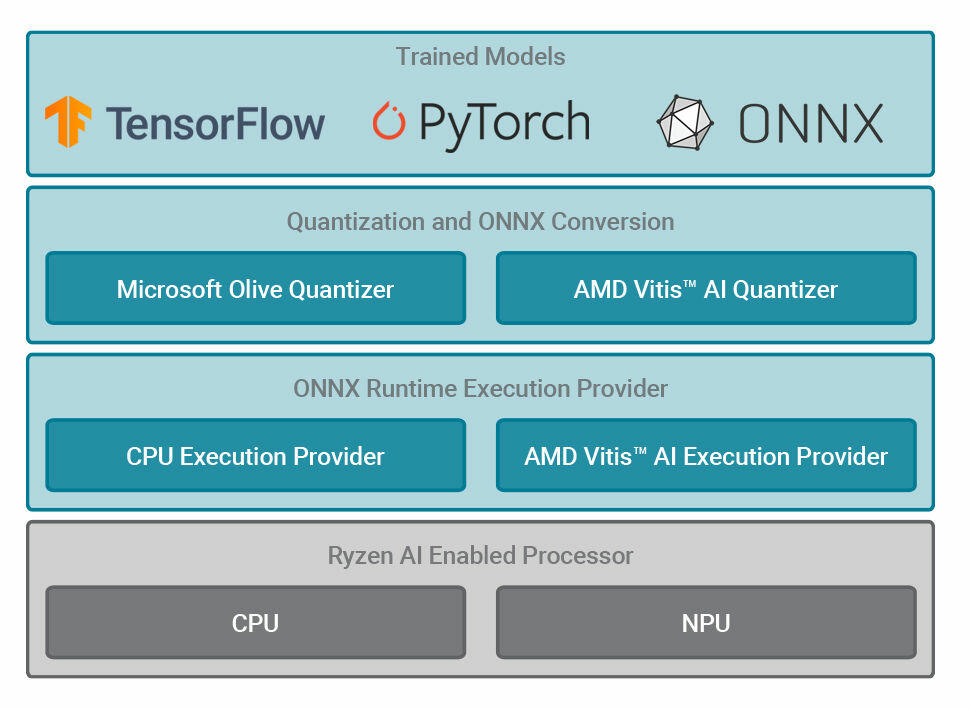

AMD Peano Open-Source-LLVM-Compiler für Ryzen-KI-Prozessoren vorgestellt

AMD hat heute den Peano Open-Source-LLVM-Compiler vorgestellt, der speziell für die Ryzen-KI-NPUs entwickelt wurde. Diese Ankündigung ist ein wichtiger Schritt für AMD, um die Leistung und die Fähigkeiten von KI-Workloads auf Consumer-Prozessoren zu verbessern. Eingesetzt werden kann Peano mit...

und natürlich auch Phonronix

Stephen Neuendorffer von Xlinx verweist darauf, dass der Compiler nur für einzelne Cores im Array mit LLVM compilieren kann. Für das gesamte NPU Array braucht es dann MLIR-AIE. Den Link hat er selbst aber falsch gesetzt.

Zuletzt bearbeitet:

E555user

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 05.10.2015

- Beiträge

- 2.175

- Renomée

- 938

Bei TechPowerUp glaubt man bei AMD einen strategischen Wandel in Richtung Software-Unternehmen zu erkennen.

Es soll von AMD-Vertretern erklärt worden sein, dass für Ryzen AI und die Instinct Serie im KI-Einsatz ein Kulturwandel bei AMD stattfinden soll um in den nächsten 3-5 Jahren auch im Bereich Software auf die Kunden zuzugehen und das Angebot und Image von AMD zu verändern.

www.techpowerup.com

www.techpowerup.com

Die Beschreibungen erinnern an die frühen Jahre der Zen-Gerenartionen. Gerade die EPYC-Sparte hatte über das Top-Management regelmässig betont, dass man in der Entwicklung genau den Kunden (gemeint waren wohl Hyperscaler) zugehört hat um die Hardware weiterzuentwickeln.

In den künftigen Softwareangeboten will man nun den grossen AI-Playern mit kombinierten Software-Hardware-Lösungen entgegenkommen.

Kommentar:

Mit dem Personalwachstum der letzten Jahre hat sich das Engagement für Software bereits deutlich gesteigert. Es bleibt ein Moving-Target, es braucht ein ständiges Engagement. Was fehlt ist die durchgängige Sichtbarkeit und Orientierung zu angebotenen Lösungen genaso wie die zuverlässige Verfügbarkeit in breitem Support für die angebotene Hardware. Es muss aus Sicht eines Entwicklers viel einfacher werden die eigenen Projekte auf AMD-Hardware anzupassen. Es fehlt nach wie vor eine klare Linie bei GPUopen oder im Marketing rund um Radeon-Features und den Software-Partnern im Gaming. Ob das mit AI dann später auch für AMD insgesamt besser klappt wird sich zeigen.

[automerge]1720636469[/automerge]

passend dazu die News zur übernahme von Silo AI

wccftech.com

wccftech.com

Es soll von AMD-Vertretern erklärt worden sein, dass für Ryzen AI und die Instinct Serie im KI-Einsatz ein Kulturwandel bei AMD stattfinden soll um in den nächsten 3-5 Jahren auch im Bereich Software auf die Kunden zuzugehen und das Angebot und Image von AMD zu verändern.

AMD is Becoming a Software Company. Here's the Plan

Just a few weeks ago, AMD invited us to Barcelona as part of a roundtable, to share their vision for the future of the company, and to get our feedback. On site, were prominent AMD leadership, including Phil Guido, Executive Vice President & Chief Commercial Officer and Jack Huynh, Senior VP &...

Die Beschreibungen erinnern an die frühen Jahre der Zen-Gerenartionen. Gerade die EPYC-Sparte hatte über das Top-Management regelmässig betont, dass man in der Entwicklung genau den Kunden (gemeint waren wohl Hyperscaler) zugehört hat um die Hardware weiterzuentwickeln.

In den künftigen Softwareangeboten will man nun den grossen AI-Playern mit kombinierten Software-Hardware-Lösungen entgegenkommen.

They are now talking to the major software companies, like Microsoft, Adobe and OpenAI, to learn what their plans are and what they need from a future hardware generation.

Kommentar:

Mit dem Personalwachstum der letzten Jahre hat sich das Engagement für Software bereits deutlich gesteigert. Es bleibt ein Moving-Target, es braucht ein ständiges Engagement. Was fehlt ist die durchgängige Sichtbarkeit und Orientierung zu angebotenen Lösungen genaso wie die zuverlässige Verfügbarkeit in breitem Support für die angebotene Hardware. Es muss aus Sicht eines Entwicklers viel einfacher werden die eigenen Projekte auf AMD-Hardware anzupassen. Es fehlt nach wie vor eine klare Linie bei GPUopen oder im Marketing rund um Radeon-Features und den Software-Partnern im Gaming. Ob das mit AI dann später auch für AMD insgesamt besser klappt wird sich zeigen.

[automerge]1720636469[/automerge]

passend dazu die News zur übernahme von Silo AI

AMD Adds Rolls-Royce To Its Customer List By Buying AI Firm For $665 Million

Chip designer AMD expanded its customer base in the AI industry today after announcing its takeover of Europe's largest private artificial intelligence lab Silo AI. The transaction is worth $665 million, and since it's all cash, AMD might have to rely on debt to finance the deal. Silo is an AI...

Zuletzt bearbeitet:

sompe

Grand Admiral Special

- Mitglied seit

- 09.02.2009

- Beiträge

- 15.753

- Renomée

- 2.500

- Mein Laptop

- Dell G5 15 SE 5505 Eclipse Black

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 7800X3D

- Mainboard

- MSI MPG X670E CARBON WIFI

- Kühlung

- Wasserkühlung

- Speicher

- 32GB DDR5-6000 CL36

- Grafikprozessor

- AMD Radeon RX 6900 XT

- Display

- 1x 32" LG 32UD89-W + 1x 24" Dell Ultrasharp 2405FPW

- SSD

- Samsung SSD 980 PRO 1TB, Crucial MX500 500GB, Intel 600p 512GB, Crucial T705 4TB

- HDD

- Western Digital WD Red 2TB, 3TB, 8TB

- Optisches Laufwerk

- LG GGC-H20L

- Soundkarte

- onboard

- Gehäuse

- Thermaltake Armor

- Netzteil

- be quiet! Dark Power Pro 11 1000W

- Betriebssystem

- Windows 10 Professional, Windows 7 Professional 64 Bit, Ubuntu 20.04 LTS

- Webbrowser

- Firefox

Ich denke eher weniger das es darum geht die Hardware nach den Anfürderungen der Software zu entwickeln sondern eher die Schnittstellen für den Zugriff der Software auf die Hardware zu liefern und sich mehr um die Optimierung der Software auf die Hardware zu konzentrieren, also genau das womit die Konkurrenz ihre Hardware puscht.

Bleibt nur zu hoffen das sie dies nicht ebenfalls nutzen um die Konkurrenz künstlich zu behindern um sich selbst einen künstlichen Vorteil zu verschaffen.

Bleibt nur zu hoffen das sie dies nicht ebenfalls nutzen um die Konkurrenz künstlich zu behindern um sich selbst einen künstlichen Vorteil zu verschaffen.

Yoshi 2k3

Admiral Special

- Mitglied seit

- 18.01.2003

- Beiträge

- 1.447

- Renomée

- 238

- BOINC-Statistiken

- Mein Laptop

- Apple Mac Book Pro 14" 2023

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7800X3D

- Mainboard

- ASUS PRIME X670E-PRO WIFI

- Kühlung

- Watercool Heatkiller IV

- Speicher

- 64 GB Team Group DDR5-6400 (2x 32 GB)

- Grafikprozessor

- Nvidia Geforce RTX 4090 FE

- Display

- Nixeus NX-EDG27

- Soundkarte

- SMSL SU-9 USB DAC

- Gehäuse

- Caselabs SM8

- Netzteil

- FSP Hydro Ti Pro 1000W

- Betriebssystem

- Windows 11 Pro

- Webbrowser

- Firefox

- Schau Dir das System auf sysprofile.de an

Computerbase berichtet auch über dieses Event im Juni:

www.computerbase.de

www.computerbase.de

Neue Strategie: AMD will auch ein Software-Unternehmen werden

AMD mangelt es an Software, das ist nicht neu. Jetzt wagt der Konzern den Umbruch, in Zukunft steht die Software im Fokus.

Yoshi 2k3

Admiral Special

- Mitglied seit

- 18.01.2003

- Beiträge

- 1.447

- Renomée

- 238

- BOINC-Statistiken

- Mein Laptop

- Apple Mac Book Pro 14" 2023

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7800X3D

- Mainboard

- ASUS PRIME X670E-PRO WIFI

- Kühlung

- Watercool Heatkiller IV

- Speicher

- 64 GB Team Group DDR5-6400 (2x 32 GB)

- Grafikprozessor

- Nvidia Geforce RTX 4090 FE

- Display

- Nixeus NX-EDG27

- Soundkarte

- SMSL SU-9 USB DAC

- Gehäuse

- Caselabs SM8

- Netzteil

- FSP Hydro Ti Pro 1000W

- Betriebssystem

- Windows 11 Pro

- Webbrowser

- Firefox

- Schau Dir das System auf sysprofile.de an

E555user

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 05.10.2015

- Beiträge

- 2.175

- Renomée

- 938

Kernel-Driver für XDNA sollte helfen den/die Coprozessoren populär zu machen. Allerdings stehen bei Puristen ggf. die notwendigen Firmware-Binaries für die einzelnen Cores im Weg. Ich bin gespannt ob und wie bald eine Art MESA für NPUs entsteht. Die Ansätze von Intel und AMD scheinen doch arg unterschiedlich und am Ende wollen für AI-Tasks auch GPU und CPU mitverwendet werden können.

Yoshi 2k3

Admiral Special

- Mitglied seit

- 18.01.2003

- Beiträge

- 1.447

- Renomée

- 238

- BOINC-Statistiken

- Mein Laptop

- Apple Mac Book Pro 14" 2023

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7800X3D

- Mainboard

- ASUS PRIME X670E-PRO WIFI

- Kühlung

- Watercool Heatkiller IV

- Speicher

- 64 GB Team Group DDR5-6400 (2x 32 GB)

- Grafikprozessor

- Nvidia Geforce RTX 4090 FE

- Display

- Nixeus NX-EDG27

- Soundkarte

- SMSL SU-9 USB DAC

- Gehäuse

- Caselabs SM8

- Netzteil

- FSP Hydro Ti Pro 1000W

- Betriebssystem

- Windows 11 Pro

- Webbrowser

- Firefox

- Schau Dir das System auf sysprofile.de an

Das ist ein interessanter Gedankengang. Dass diese Art von Treiber grundsätzlich im "accel"-Subsystem des Kernels beheimatet sind bzw sein werden, ergibt ja auf jeden Fall Sinn. Ist das nicht ursprünglich auch von Intel/Habana Labs eingebracht worden? Wie man daraus einen kompletten Softwarestack macht, bleibt definitiv spannend. Wobei es vermutlich auch nicht "schlimm" wäre, wenn die Hersteller alle unterschiedliche Ansätze verfolgen würden.

Am Ende ist es vielleicht eher eine strategische denn eine technische Entscheidung. Gegen wen muss man sich positionieren, um Erfolg zu haben? Ist es eher Intel vs. AMD oder x86 vs. ARM?

Am Ende ist es vielleicht eher eine strategische denn eine technische Entscheidung. Gegen wen muss man sich positionieren, um Erfolg zu haben? Ist es eher Intel vs. AMD oder x86 vs. ARM?

E555user

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 05.10.2015

- Beiträge

- 2.175

- Renomée

- 938

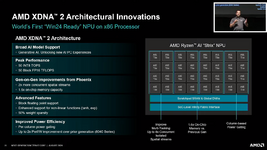

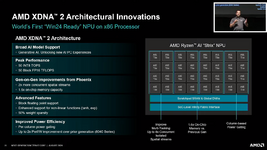

Aus Hot Chips 2024 eine XDNA2 Folie aus dem Vortrag zu Zen5 und StrixPoint.

Eine gute Übersicht über die AMD/Xilinx basierte AI-Lösungen gab es in der Hot Chips 2024 Session 5 durch Tomai Knopp AMD.

XDNA2 ist eine Variante der auch in Versal verwendeten AI Engines für maschinelles lernen, AIE-ML v2. Es ist die zweite Generation der AIE-ML Architektur bzw. die dritte AI Architektur von AMD/Xilinx überhaupt.

Eine gute Übersicht über die AMD/Xilinx basierte AI-Lösungen gab es in der Hot Chips 2024 Session 5 durch Tomai Knopp AMD.

XDNA2 ist eine Variante der auch in Versal verwendeten AI Engines für maschinelles lernen, AIE-ML v2. Es ist die zweite Generation der AIE-ML Architektur bzw. die dritte AI Architektur von AMD/Xilinx überhaupt.

Zuletzt bearbeitet:

E555user

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 05.10.2015

- Beiträge

- 2.175

- Renomée

- 938

Ähnliche Themen

- Antworten

- 0

- Aufrufe

- 464

- Antworten

- 44

- Aufrufe

- 2K

- Antworten

- 0

- Aufrufe

- 3K