App installieren

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Anmerkung: This feature may not be available in some browsers.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Erstes Review einer AMD ATI Radeon HD 3870 X2

- Ersteller pipin

- Erstellt am

- Mitglied seit

- 16.10.2000

- Beiträge

- 24.371

- Renomée

- 9.696

- Standort

- East Fishkill, Minga, Xanten

- Aktuelle Projekte

- Je nach Gusto

- Meine Systeme

- Ryzen 9 5900X, Ryzen 7 3700X

- BOINC-Statistiken

- Folding@Home-Statistiken

- Mein Laptop

- Samsung P35 (16 Jahre alt ;) )

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 9 5900X

- Mainboard

- ASRock B550

- Speicher

- 2x 16 GB DDR4 3200

- Grafikprozessor

- GeForce GTX 1650

- Display

- 27 Zoll Acer + 24 Zoll DELL

- SSD

- Samsung 980 Pro 256 GB

- HDD

- diverse

- Soundkarte

- Onboard

- Gehäuse

- Fractal Design R5

- Netzteil

- be quiet! Straight Power 10 CM 500W

- Tastatur

- Logitech Cordless Desktop

- Maus

- Logitech G502

- Betriebssystem

- Windows 10

- Webbrowser

- Firefox, Vivaldi

- Internetanbindung

- ▼250 MBit ▲40 MBit

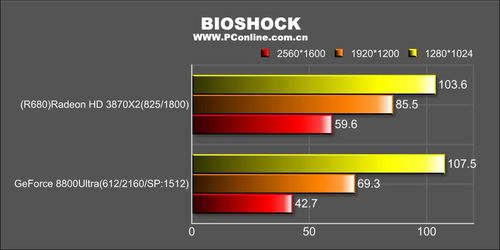

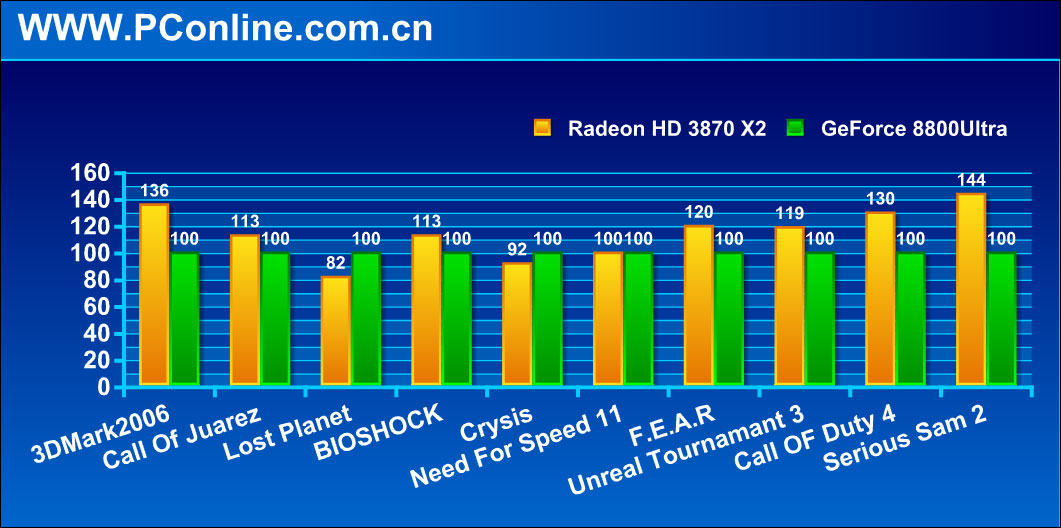

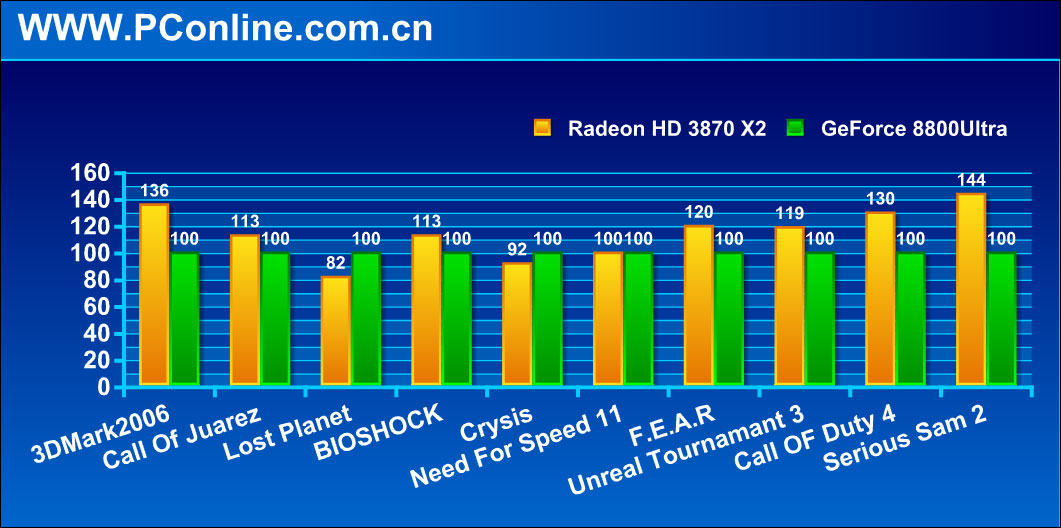

Die chinesische Seite PConline.com.cn hat ein erstes Review einer AMD ATI Radeon HD 3870 X2 online gestellt, in der diese Karte gegen eine NVIDIA GeForce 8800 Ultra getestet wurde.

Sowohl in synthetischen , als auch in Spiele-Benchmarks kann sich die ATI Radeon HD 3870 X2 dabei deutlich von der NVIDIA GeForce 8800 Ultra absetzen. Dabei verbraucht das Testsystem mit dieser Karte auch etwa 10 Prozent mehr.

<center><a href="http://www.planet3dnow.de/photoplog/index.php?n=1535"><img src="http://www.planet3dnow.de/photoplog/file.php?n=1535"></a><br><font size="-3">Bildquelle: PConline.com.cn</font></center>

<center><a href="http://www.planet3dnow.de/photoplog/index.php?n=1536"><img src="http://www.planet3dnow.de/photoplog/file.php?n=1536"></a><br><font size="-3">Bildquelle: PConline.com.cn</font></center>

<b>Quelle:</b> <a href="http://www.pconline.com.cn/diy/graphics/reviews/0801/1210234.html" target="b">AMD ATI Radeon HD 3870 X2</a>

Sowohl in synthetischen , als auch in Spiele-Benchmarks kann sich die ATI Radeon HD 3870 X2 dabei deutlich von der NVIDIA GeForce 8800 Ultra absetzen. Dabei verbraucht das Testsystem mit dieser Karte auch etwa 10 Prozent mehr.

<center><a href="http://www.planet3dnow.de/photoplog/index.php?n=1535"><img src="http://www.planet3dnow.de/photoplog/file.php?n=1535"></a><br><font size="-3">Bildquelle: PConline.com.cn</font></center>

<center><a href="http://www.planet3dnow.de/photoplog/index.php?n=1536"><img src="http://www.planet3dnow.de/photoplog/file.php?n=1536"></a><br><font size="-3">Bildquelle: PConline.com.cn</font></center>

<b>Quelle:</b> <a href="http://www.pconline.com.cn/diy/graphics/reviews/0801/1210234.html" target="b">AMD ATI Radeon HD 3870 X2</a>

das es selbst bei nem praktischen spiel so gut für die X2 aussieht hab ich garnicht glauben wollen. Das mit dem verbrauch...da würde mich vor allem mal der idle-wert interessieren, da die 3xxxxer sich ja eigentlich recht gut runtertakten können...

Und ein traum wäre ein test in Bioshock gewesen, da das game bisher eigentlich irgendwie so garnicht auf SLI/CF angesprungen ist. Wenn dem jetzt anders sein sollte, dann würde ich den ati´lern meinen respekt für die treiber zollen...

Und ein traum wäre ein test in Bioshock gewesen, da das game bisher eigentlich irgendwie so garnicht auf SLI/CF angesprungen ist. Wenn dem jetzt anders sein sollte, dann würde ich den ati´lern meinen respekt für die treiber zollen...

whippersnapper

Grand Admiral Special

- Mitglied seit

- 01.08.2006

- Beiträge

- 2.211

- Renomée

- 70

- Standort

- Nürnberg

- Mein Laptop

- Sony VAIO F11@Core i7@4GB RAM@GT330@Full-HD

- Details zu meinem Desktop

- Prozessor

- Intel Core i7 860 @ 4 Ghz

- Mainboard

- Asus Sabertooth 55i

- Kühlung

- Prolimatech Mega Shadow @ NB Multiframe M12-S2

- Speicher

- Corsair Dominator GT @ 2200 Mhz/ CL8

- Grafikprozessor

- Palit GTX 480 @825/950 Mhz

- Display

- Samsung SM 2693HM @1920 x 1200

- HDD

- Western Digital Caviar Black 1 TB x 2 & Corsair P256

- Optisches Laufwerk

- Sony DVD-RW & LG BluRay-ROM

- Soundkarte

- Onboard@24 Bit

- Gehäuse

- Lian Li PC9 @ 3 NB Multiframe M12 S2/S1

- Netzteil

- Seasonic X-750 80plus Gold

- Betriebssystem

- Windows 7 Ultimate x64

- Webbrowser

- Firefox 3.6

Auf der Homepage gabs den Test

Edit: Anscheinend bewahrheitet sich die Aussage, dass die Karte mit 825 Mhz Chiptakt daher kommt.

Zuletzt bearbeitet:

@whippersnapper:

Dankeschön!

Die Werte sehen trotzdem besser aus als vermutet....1280*1024 scheint wohl wirklich schon CPU-Limitiert zu sein...die höheren Auflösungen hingegen machen doch ganz schon was her...aber es sind auflösungen, die nicht unbedingt ein massenpublikum spielt. Trotz allem performt die X2 echt besser als ichs erwartet hätte. Respekt...netter Lückenflüller bis zu den zwei RV 770 auf einer karte.

Dazu der gute ruf der 38er serie...ATi könnte sich gerade zu AMDs stütze entwickeln, wenn schon die CPUs aktuell nicht viel taugen...(verglichen mit der konkurrenz...an sich sind es ja keine sooo schlechten produkte...)

edit:

aber wie siehts aus, wenn man zwei 8800 GTS im SLI antreten lässt...oder gar 2 Ultras? Das die X2 dann verliert ist klar...das ist auch nicht verwerflich, sollte sie doch als eine Karte betrachtet werden und nicht als zwei (ist ja sogar nen single PCB-Design)...aber wenn man dagegen dann 2 X2 im CF...also Quad-CF...positioniert, dann dürfte der zugewinn der X2er wohl deutlich geringer sein, da CF/SLI mit der zunehmenden Menge an Grakas nach wie vor immer schlechter skalliert.

Oder wurde das bei der X2 auch schon verbessert? Sollte dem so sein, dann hätte sich Ati ja sogar die absolute Performancekrone fast zurückerobert...

Dankeschön!

Die Werte sehen trotzdem besser aus als vermutet....1280*1024 scheint wohl wirklich schon CPU-Limitiert zu sein...die höheren Auflösungen hingegen machen doch ganz schon was her...aber es sind auflösungen, die nicht unbedingt ein massenpublikum spielt. Trotz allem performt die X2 echt besser als ichs erwartet hätte. Respekt...netter Lückenflüller bis zu den zwei RV 770 auf einer karte.

Dazu der gute ruf der 38er serie...ATi könnte sich gerade zu AMDs stütze entwickeln, wenn schon die CPUs aktuell nicht viel taugen...(verglichen mit der konkurrenz...an sich sind es ja keine sooo schlechten produkte...)

edit:

aber wie siehts aus, wenn man zwei 8800 GTS im SLI antreten lässt...oder gar 2 Ultras? Das die X2 dann verliert ist klar...das ist auch nicht verwerflich, sollte sie doch als eine Karte betrachtet werden und nicht als zwei (ist ja sogar nen single PCB-Design)...aber wenn man dagegen dann 2 X2 im CF...also Quad-CF...positioniert, dann dürfte der zugewinn der X2er wohl deutlich geringer sein, da CF/SLI mit der zunehmenden Menge an Grakas nach wie vor immer schlechter skalliert.

Oder wurde das bei der X2 auch schon verbessert? Sollte dem so sein, dann hätte sich Ati ja sogar die absolute Performancekrone fast zurückerobert...

Zuletzt bearbeitet:

Friday

Grand Admiral Special

- Mitglied seit

- 11.11.2001

- Beiträge

- 2.318

- Renomée

- 4

- Standort

- Landshut

- Details zu meinem Desktop

- Prozessor

- Intel Core i7 920 @3GHz

- Mainboard

- Asus P6T

- Kühlung

- Zalman CNPS 9900

- Speicher

- 3x2048 MB Corsair DDR3 1600

- Grafikprozessor

- ATI Radeon 5870 1024 MB

- Display

- 24" Samsung 2493 HM 1920x1200

- HDD

- 160 GB Intel X25M SSD, 1000 GB Samsung F1

- Optisches Laufwerk

- DVD-Brenner LG

- Soundkarte

- Soundblaster X-Fi Extreme Music

- Gehäuse

- Coolermaster HAF 932

- Netzteil

- Corsair TX 750W

- Betriebssystem

- Windows 7 Home Premium 64 bit

- Webbrowser

- Firefox 3.6

Hiho!

Hier nochmal die Zusammenfassung aller Benches in einer Grafik:

Wenn sich das bewahrheitet, dann werde ich sie mir doch kaufen!

Ich hätte nicht gedacht, dass eine Dualchipkarte über alle Spiele hinweg so eine relativ konstante Leisung bringen kann.

Wenns stimmt - Respekt ATI!

Greetz

Friday

Hier nochmal die Zusammenfassung aller Benches in einer Grafik:

Wenn sich das bewahrheitet, dann werde ich sie mir doch kaufen!

Ich hätte nicht gedacht, dass eine Dualchipkarte über alle Spiele hinweg so eine relativ konstante Leisung bringen kann.

Wenns stimmt - Respekt ATI!

Greetz

Friday

Zuletzt bearbeitet:

Psychodelik

Admiral Special

- Mitglied seit

- 29.02.2004

- Beiträge

- 1.224

- Renomée

- 22

- Details zu meinem Desktop

- Prozessor

- Intel Core i7-3770 K

- Mainboard

- Gigabyte GA-Z77X-UD5H

- Kühlung

- top-blow Kühler inkl. 2 x 140 mm Lüfter

- Speicher

- G-skill 2 x 8 GB RAM

- Grafikprozessor

- Sapphire R9-390 NITRO with backplate, 8GB RAM

- Display

- HP ZR2440w

- SSD

- Samsung SSD 830 Series

- HDD

- Samsung HD240 UI

- Optisches Laufwerk

- LG Blue-Ray Brenner, LG DVD Brenner

- Soundkarte

- Creative Sound Blaster ZxR

- Netzteil

- Enermax 750 Watt Netzteil inkl. Kabelmanagement

- Betriebssystem

- Microsoft Windows 10 Pro x64 Edition

- Webbrowser

- Firefox, Vivaldi

Muss man ein Crossfire Board haben um die Graka zu verwenden oder langt eine der eine 16 x PCI-E Slot hat?

Kann mir jemand diesbezüglich eine konkrete Antwort geben bitte?

Kann mir jemand diesbezüglich eine konkrete Antwort geben bitte?

just m3

Admiral Special

- Mitglied seit

- 31.10.2007

- Beiträge

- 1.741

- Renomée

- 23

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 5900X

- Mainboard

- MSI MAG B550 Gaming Edge WiFi

- Kühlung

- Noctua NH-D15

- Speicher

- 32GB Corsair Vengeance RGB DDR4-3800 CL16

- Grafikprozessor

- ASUS TUF RTX 3090 OC

- Display

- Acer Predator X34bmiphz

- SSD

- WD Black NVMe 500GB

- HDD

- Seagate Archive v2 8TB

- Soundkarte

- FiiO Olympus 2 E10K

- Gehäuse

- Nanoxia Deep Silence 1 Rev. B

- Netzteil

- be quiet! Dark Power Pro 11 750W

- Tastatur

- Logitech G15 Refresh

- Maus

- Logitech G MX518

- Betriebssystem

- Win 10 Pro x64

- Verschiedenes

- beyerdynamic DT 880 Edition 250 Ohm

aber wie siehts aus, wenn man zwei 8800 GTS im SLI antreten lässt...oder gar 2 Ultras? Das die X2 dann verliert ist klar...das ist auch nicht verwerflich, sollte sie doch als eine Karte betrachtet werden und nicht als zwei (ist ja sogar nen single PCB-Design)...aber wenn man dagegen dann 2 X2 im CF...also Quad-CF...positioniert, dann dürfte der zugewinn der X2er wohl deutlich geringer sein, da CF/SLI mit der zunehmenden Menge an Grakas nach wie vor immer schlechter skalliert.

Interessant wäre 1x 3870 X2 vs. 2x 3870 CF und 2x 3870 X2 vs. triple-SLI

Man brauch kein CrossfireBoard da das Crossfire quasie auf dem PCB mittels PCI Express Bridge passiert. ein 16x Slote reicht aus. Was mich mal interessieren würde ob hier PCI Express 2.0 schon was bringt bei den normalen 3870 bringts ja angeblich nichts. Aber hier werkeln ja dann 2 Chhips die ja dann quasie jeweils nur 8 lanes in einem 16x slot nutzen können. ICh glaub das wird im CCC sogar so angezeigt. Da müsste ja dann die Bandbreiten verdoppelung shcon was bringen oder?

theoretisch

Die einzigen games, wo sie einbricht im vergleich zur ultra sind Lost Planet und Crysis...allerdings war das noch nie sehr ati-freundlich, hab ich den eindruck

Auf jeden fall ne bessere karte als ich dachte

Die einzigen games, wo sie einbricht im vergleich zur ultra sind Lost Planet und Crysis...allerdings war das noch nie sehr ati-freundlich, hab ich den eindruck

Auf jeden fall ne bessere karte als ich dachte

Zuletzt bearbeitet:

W0RSCHD

Admiral Special

- Mitglied seit

- 28.02.2006

- Beiträge

- 1.489

- Renomée

- 22

- Standort

- In der schönen Pfalz :)

- Mein Laptop

- Acer Aspire 5750G Corei7 2630QM

- Details zu meinem Desktop

- Prozessor

- I7 6700k @ 4800Mhz

- Mainboard

- Asus Maximus VIII Hero

- Kühlung

- Corsair H110i GTX

- Speicher

- 32GB DDR4 3200 GSkill Ripjaws

- Grafikprozessor

- Palit Super Jetstream 1080 Ti

- Display

- LG IPS 277L

- SSD

- Samsung 950pro, Sandisk Ultra 1TB

- HDD

- WD15EADS

- Optisches Laufwerk

- LG Sata DVD Brenner

- Soundkarte

- Creative Soundblaster Z

- Gehäuse

- BeQuiet Silent Base 800 Modded

- Netzteil

- Seasonic 750W Gold

- Betriebssystem

- Windows 10 Pro 64Bit

- Webbrowser

- Firefox

- Verschiedenes

- Philips 43" 4K Monitor

was bräuchte man für nen netzteil für nen x2 crossfire system?

Schnurrkater

Captain Special

- Mitglied seit

- 08.01.2004

- Beiträge

- 242

- Renomée

- 0

Sieht mal nicht schlecht aus.

Nur die Verfügbarkeit der Karte wird nicht gegeben sein. Selbst die 3870 ist noch schlecht verfügbar, da wirds mit der X2 noch viel viel übler aussehen in naher Zukunft.

Nur die Verfügbarkeit der Karte wird nicht gegeben sein. Selbst die 3870 ist noch schlecht verfügbar, da wirds mit der X2 noch viel viel übler aussehen in naher Zukunft.

prinz_will

Lieutnant

- Mitglied seit

- 19.04.2007

- Beiträge

- 58

- Renomée

- 0

Das sieht doch alles sehr vielverprechend aus. Wenn sich jetzt noch der Preis unter 400€ bewahrheitet, gibt es endlich einen neuen Spitzreiter, zu einem guten Preis.

Auch die Leistungsaufnahme sieht besser als erwartet aus.

Da hat AMD ja wieder eine echte High-End Karte im Programm.

Freut mich...

Auch die Leistungsaufnahme sieht besser als erwartet aus.

Da hat AMD ja wieder eine echte High-End Karte im Programm.

Freut mich...

Opteron

Redaktion

☆☆☆☆☆☆

Passt vielleicht auch noch hier rein, oder gleich ne neue news:

http://www.xbitlabs.com/news/video/...rack_with_Next_Generation_Graphics_Chips.html

Mit mid-2008, meint erH2, Ende Q2/08.

ciao

Alex

AMD Reportedly On Track with Next-Generation Graphics Chips.

AMD Plans to Release ATI RV770 Graphics Chips in Mid-2008:

ATI, graphics product group of Advanced Micro Devices, reportedly aims to release its next-generation code-named R700-series graphics processing units (GPUs) in mid-2008. The news comes as a surprise, as earlier it was revealed that the ATI R700-series chips are only due either in late 2008 or early in 2009.

http://www.xbitlabs.com/news/video/...rack_with_Next_Generation_Graphics_Chips.html

Mit mid-2008, meint er

ciao

Alex

Zuletzt bearbeitet:

LordNord

Redaktion

☆☆☆☆☆☆

- Mitglied seit

- 07.09.2005

- Beiträge

- 5.868

- Renomée

- 529

- Standort

- S-H

- Mitglied der Planet 3DNow! Kavallerie!

- BOINC-Statistiken

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 9 3900X

- Mainboard

- ASUS TUF Gaming B550-Plus

- Kühlung

- be quiet! Dark Rock 4

- Speicher

- 2x16GB Crucial DDR4 3200

- Grafikprozessor

- ASUS ROG STRIX Vega 64 GAMING OC

- Display

- AOC Q3279VWFD8

- SSD

- Kingston A2000 1TB + WD Blue SN550 1TB Crucial BX500 2TB + Mega Fastro MS200 2TB Extern

- HDD

- 8TB extern

- Soundkarte

- Onboard

- Gehäuse

- Fractal Design Meshify 2 Compact Lite

- Netzteil

- Be quiet! Pure Power 9 600W

- Tastatur

- Corsair K70 MK.2 Low Profile

- Betriebssystem

- Win 10 64Bit

- Webbrowser

- Firefox

- Internetanbindung

-

▼200

▲200

Sicher eine sehr gute Umsetzung einer MultiGPUlösung,

aber meiner Meinung nach wird Nvidia "zu schnell" die 9xxxer Serie einführen und damit verhindern das sie die 3870X2 im Markt durchsetzt.

Denn eine (jetzt mal geratene) 9800GTS/X wird mindestens diese Leistung bringen und deutlich niedrigeren Stromverbrauch haben.

Dennoch halte die die 3xxx Serie für eine sehr gelungene.

Ich, mit meinem schmalen Budget spekuliere auf eine 3850, die ja ein tolles P/L Verhältnis hat.

LN

aber meiner Meinung nach wird Nvidia "zu schnell" die 9xxxer Serie einführen und damit verhindern das sie die 3870X2 im Markt durchsetzt.

Denn eine (jetzt mal geratene) 9800GTS/X wird mindestens diese Leistung bringen und deutlich niedrigeren Stromverbrauch haben.

Dennoch halte die die 3xxx Serie für eine sehr gelungene.

Ich, mit meinem schmalen Budget spekuliere auf eine 3850, die ja ein tolles P/L Verhältnis hat.

LN

larsbo

Grand Admiral Special

- Mitglied seit

- 20.06.2003

- Beiträge

- 5.864

- Renomée

- 62

- Details zu meinem Desktop

- Prozessor

- Ryzen 5 3400G

- Mainboard

- Gigabyte B450I Aorus pro Wifi

- Kühlung

- Noctua NH-L9a

- Speicher

- 32 GB, 2x ADATA 16GB single rank PC4-3200 1,2V (Samsung 16Gbit 2666-Chips)

- Grafikprozessor

- APU

- SSD

- Samsung 970Pro 1TB NVMe PCIe3

- Optisches Laufwerk

- Pioneer BD-RE slim-line

- Soundkarte

- on-board

- Gehäuse

- SilverStone ML08-H

- Netzteil

- Corsair SF450 (80PlusGold)

- Betriebssystem

- Win10pro 64

Sicher eine sehr gute Umsetzung einer MultiGPUlösung,

aber meiner Meinung nach wird Nvidia "zu schnell" die 9xxxer Serie einführen und damit verhindern das sie die 3870X2 im Markt durchsetzt.

Denn eine (jetzt mal geratene) 9800GTS/X wird mindestens diese Leistung bringen und deutlich niedrigeren Stromverbrauch haben.

Dennoch halte die die 3xxx Serie für eine sehr gelungene.

Ich, mit meinem schmalen Budget spekuliere auf eine 3850, die ja ein tolles P/L Verhältnis hat.

LN

Leistungsmäßig würd ich Dir recht geben. nV braucht nur zwei G92 auf ein PCB hauen, und sie sind im Mittel vermutlich wieder deutlich vorn. Und es sieht ja spekulationsmäßig so aus, als würde nV entgegen allen ursprünglich letztes Jahr gemachten Spekulationen doch erstmal auf allenfalls leicht modifizierten G92 rumreiten wird. Aber Stromverbrauch von zwei G92 muss höher liegen als bei zwei 3870. Einzeln ist das ja auch so.

Ich persönlich mag ja keine SLI/CF-Lösungen, aber vermutlich wird der Trend dahingehen, wies ausschaut.

Auf der anderen Seite halte ich es immer noch für möglich, dass nv doch noch demnächst eine ganz neue Architektur raushaut. Bevor G80 rauskam war ja die Spekulationsmasse auch eher dürftig und teilweise sogar falsch ("G80 wird keine unified shader haben....."). Ich kann mir irgendwie nicht vorstellen, dass die nach eineinhalb Jahren nicht mehr als ne G92 hinbekommen haben.....

funkflix

Grand Admiral Special

- Mitglied seit

- 03.06.2002

- Beiträge

- 7.499

- Renomée

- 86

- Standort

- Heilbronx

- Details zu meinem Desktop

- Prozessor

- Intel Core 2 Quad Q9550

- Mainboard

- Gigabyte EP45-Extreme

- Kühlung

- Scythe Mugen 2

- Speicher

- 2 x 2GB Chaintech Apogee GT PC8500

- Grafikprozessor

- ATI HD5770

- Display

- Samsung 226BW

- HDD

- Supertalent Ultradrive GX 64GB + Samsung 320GB

- Optisches Laufwerk

- Samsung

- Soundkarte

- Creative X-Fi Xtreme Music

- Gehäuse

- Chieftec Mesh

- Netzteil

- Coolermaster 850W

- Betriebssystem

- Windows Vista 64Bit

- Webbrowser

- Firefox

nV braucht nur zwei G92 auf ein PCB hauen, und sie sind im Mittel vermutlich wieder deutlich vorn.

http://www.xtremesystems.org/forums/showpost.php?p=2578885&postcount=1

SLI skaliert halt nicht ganz so gut wie Crossfire. Eine einzelne 8800GT G92 ist ja schon ein gutes Stück schneller als die 3870, bei CF vs. SLI sieht es dann schon wieder etwas anders aus.

Mal schaun ob ich mir so eine Karte hole, oder doch 2 mal eine normale 3870er, damit wäre ich etwas flexibler, auch was Wasserkühlung betrifft.

Fusseltuch

Vice Admiral Special

- Mitglied seit

- 29.12.2004

- Beiträge

- 848

- Renomée

- 8

- Details zu meinem Desktop

- Prozessor

- Intel C2Q6600 @ 3.2GHz

- Mainboard

- MSI P35 Neo2-FR

- Kühlung

- Alpenföhn Gross Clockner

- Speicher

- 8GB DDR2-800

- Grafikprozessor

- HD6850

- Display

- 24" Eizo SX2461W 1920x1200 / 21.3" Eizo S2100 1600x1200

- HDD

- 160GB X-25M G2 2x 640GB WD6400AAKS 1x 500GB WD5000AACS

- Optisches Laufwerk

- LiteOn iHas120

- Soundkarte

- Onboard

- Gehäuse

- Antec P180

- Netzteil

- Enermax Modu82+ 425W

- Betriebssystem

- Win7 64bit

- Webbrowser

- Opera 11

Denn eine (jetzt mal geratene) 9800GTS/X wird mindestens diese Leistung bringen und deutlich niedrigeren Stromverbrauch haben.

Stromverbrauch wird kaum deutlich drunter liegen. Die 9er serie ist keine neue plattform sondern einfach nur ein aufgemotzter GF8. Und bis auf die GTX sind wohl alle in 65nm geplant - das alleine wird vermutlich schon verhindern, dass der stromverbrauch deutlich sinkt, bei gleichzeitig erhöhten taktraten.

Alyva

Vice Admiral Special

- Mitglied seit

- 12.01.2008

- Beiträge

- 712

- Renomée

- 6

- Details zu meinem Desktop

- Prozessor

- AMD Athlon 64 3500+ Newcastle

- Mainboard

- K8N SLI Platinum

- Kühlung

- Boxed Variante

- Speicher

- MDT 2* 1 GB PC400 CL2

- Grafikprozessor

- Geforce 6800 GT Ultra

- Display

- 17" AOC 1280*1024

- HDD

- WD 360 GD / ST3200822A

- Optisches Laufwerk

- Toshiba DVD-Rom SD-M1912

- Soundkarte

- Soundblaster Audigy

- Netzteil

- 380 Watt

- Betriebssystem

- Windows XP

- Webbrowser

- Maxthon

Im P/L sieht die ultra dagegen ziemlich alt aus, sollte es bei max. 400 Euro bleiben.

Wan_Mateng

Admiral Special

Irgendwie kann ich die Freudenausbrüche hier nicht so ganz teilen. Das die ATI gut abschneidet steht außer Frage. Aber im Verhältnis gesehen wie lange die Ultra auf dem Markt ist dämpft das doch erheblich den Gesamteindruck.

Irgendwie war das schon immer bei ATI wenn man gerade nicht weiter weiß dann werden halt einfach zwei GPU's auf eine Karte verbaut um Mithalten zu können bzw besser zu werden.

Mal schauen was beide Hersteller im QII dem Kunden vorsetzen. Wahrscheinlich ist dann dieses Produkt schon wieder Geschichte was im Grunde eh nur eine Übergangslösung war.

mfg

Irgendwie war das schon immer bei ATI wenn man gerade nicht weiter weiß dann werden halt einfach zwei GPU's auf eine Karte verbaut um Mithalten zu können bzw besser zu werden.

Mal schauen was beide Hersteller im QII dem Kunden vorsetzen. Wahrscheinlich ist dann dieses Produkt schon wieder Geschichte was im Grunde eh nur eine Übergangslösung war.

mfg

Denn eine (jetzt mal geratene) 9800GTS/X wird mindestens diese Leistung bringen und deutlich niedrigeren Stromverbrauch haben.

Dennoch halte die die 3xxx Serie für eine sehr gelungene.

Ich, mit meinem schmalen Budget spekuliere auf eine 3850, die ja ein tolles P/L Verhältnis hat.

LN

Gerade die Leistungsaufnahme ist AMDs grosse Stärke. Die aktuellen Radeon Karten haben eine geringe Leistungsaufnahme unter Last und spitzen Werte im Idle und auch bei geringerer Last. AMD hat Powerplay vom Notebook auf den Desktop gebracht und damit sehr effiziente Hardware geschaffen.

Die nächste "grosse" Grafikkarte von Nvidia wird ja (das Gegenstück) die 9800 GX2 werden. Die mag vielleicht wieder etwas schneller sein, wird aber sicher auch wieder einen bedeutend höheren Strombedarf haben.

Aber jetzt gibt es erstmal die neue Referenz von AMD. Ist doch auch schön.

Mit der Raeon 3850 kann man eigentlich nichts falsch machen. Ich habe selber eine mit 512MB und bin 100% zufrieden. Ich hatte noch nie eine so gute Grafikkarte für 150 €.

AvenDexx

Commodore Special

- Mitglied seit

- 20.07.2005

- Beiträge

- 386

- Renomée

- 2

- Aktuelle Projekte

- QMC

- Lieblingsprojekt

- QMC

- Meine Systeme

- Intel Core2Quad Q6600 4x2400MHz @ 4x3600MHz

- BOINC-Statistiken

- Details zu meinem Desktop

- Prozessor

- Intel Q6600 @ 3600MHz

- Mainboard

- ASUS P5B Premium P965

- Kühlung

- Wakü Cuplex XT DI, Tripple 120er Radi

- Speicher

- 2x1024MB SuperTalent DDRII-1000

- Grafikprozessor

- PNY GeForce 8800GTX 630/1550/2030MHz

- Display

- Acer AL1916 DVI

- HDD

- 1x Samsung SATA 80GB / 1x Samsung SATA 160GB / 1x Samsung SATAII 250GB

- Optisches Laufwerk

- LiteOn SOHW-1673S DVD-Brenner

- Soundkarte

- Creativ Labs Audigy Player

- Gehäuse

- Thermaltake Shark Silver

- Netzteil

- OCZ GameXStream 700W

- Betriebssystem

- Microsft Windows Vista Home Premium 32bit

- Webbrowser

- FireFox

- Verschiedenes

- Als zweites Betriebssystem habe ich noch immer Windows XP Home SP2 am laufen.

Immer bei ATi?

Das ist die erste offizielle und auf dem Markt erscheinende High-End-Lösung, die mit zwei GPUs daherkommt. NVidia hat das mit der 7900GX2 vorgemacht, weil sie damals einfach keine Chance gegen die X1950-Serie hatten.

Da verdrehst du also was.

Das ist die erste offizielle und auf dem Markt erscheinende High-End-Lösung, die mit zwei GPUs daherkommt. NVidia hat das mit der 7900GX2 vorgemacht, weil sie damals einfach keine Chance gegen die X1950-Serie hatten.

Da verdrehst du also was.

SPINA

Grand Admiral Special

- Mitglied seit

- 07.12.2003

- Beiträge

- 18.122

- Renomée

- 985

- Mein Laptop

- Lenovo IdeaPad Gaming 3 (15ARH05-82EY003NGE)

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 3700X

- Mainboard

- ASUS PRIME X370-PRO

- Kühlung

- AMD Wraith Prism

- Speicher

- 2x Micron 32GB PC4-25600E (MTA18ASF4G72AZ-3G2R)

- Grafikprozessor

- Sapphire Pulse Radeon RX 7600 8GB

- Display

- LG Electronics 27UD58P-B

- SSD

- Samsung 980 PRO (MZ-V8P1T0CW)

- HDD

- 2x Samsung 870 QVO (MZ-77Q2T0BW)

- Optisches Laufwerk

- HL Data Storage BH16NS55

- Gehäuse

- Lian Li PC-7NB

- Netzteil

- Seasonic PRIME Gold 650W

- Betriebssystem

- Debian 12.x (x86-64)

- Verschiedenes

- ASUS TPM-M R2.0

Das gab es bei ATi auch früher schon einmal und zwar mit der ATi Rage Fury Maxx auf Rage 128 Pro Basis, die gegen die GeForce 256 ins Feld geführt wurde. Zwar bot diese eine zeitgemäße Geschwindigkeit, gerade unter 32-Bit, aber technologisch konnte sie mangels T&L und einiger anderer Funktionen nicht mithalten. Eine Radeon 9800 Pro Maxx mit zwei R350 war zwar geplant, kam aber nicht auf den Markt, ebenso wie eine Radeon X1950 Pro Maxx mit zwei RV570. Beide Mal wurden lediglich Prototypen von Sapphire der Öffentlichkeit präsentiert. 3dfx war darin ebenfalls groß, wie die Voodoo 5 5500 mit zwei VSA100 beweist. Die Voodoo 5 6000 mit vier VSA100 ist bekanntlich nicht mehr in Serienproduktion gegangen. Was die GeForce 7900 GX und 7950 GX2 von nVidia angeht, so basieren diese auf einem Sandwich Design mit zwei Platinen. Das ist der Wärmeabfuhr nicht gerade zuträglich. Das wird sich wohl auch bei der GeForce 9900 GX2 so verhalten. In dem Punkt sind und waren die Mitbewerber im Vorteil.Immer bei ATi?

Das ist die erste offizielle und auf dem Markt erscheinende High-End-Lösung, die mit zwei GPUs daherkommt.

Zuletzt bearbeitet:

wadenbeisser

Vice Admiral Special

- Mitglied seit

- 03.12.2007

- Beiträge

- 825

- Renomée

- 2

Immer bei ATi?

Das ist die erste offizielle und auf dem Markt erscheinende High-End-Lösung, die mit zwei GPUs daherkommt. NVidia hat das mit der 7900GX2 vorgemacht, weil sie damals einfach keine Chance gegen die X1950-Serie hatten.

Da verdrehst du also was.

Falsch...die erste war die Rage Fury Maxx, in der Zwischenzeit war aber nVidia schon mit der GeForce 7950 GX2 und scheinbar einer GeForce 7900 GX2 mit dabei.

Edit: zu spät...hab zu lange nach Bildern gesucht ^^

Zuletzt bearbeitet:

Ähnliche Themen

- Antworten

- 1K

- Aufrufe

- 71K

- Antworten

- 611

- Aufrufe

- 46K

- Antworten

- 0

- Aufrufe

- 1K

kleiner Spaß

kleiner Spaß