App installieren

How to install the app on iOS

Follow along with the video below to see how to install our site as a web app on your home screen.

Anmerkung: This feature may not be available in some browsers.

Du verwendest einen veralteten Browser. Es ist möglich, dass diese oder andere Websites nicht korrekt angezeigt werden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Du solltest ein Upgrade durchführen oder ein alternativer Browser verwenden.

Zurück zu Nvidia - Endlich wieder zuhause!

- Ersteller TobiWahnKenobi

- Erstellt am

skelletor

Grand Admiral Special

- Mitglied seit

- 14.06.2002

- Beiträge

- 5.369

- Renomée

- 325

- Standort

- Dresden

- Aktuelle Projekte

- Simap, Spinhenge, Poem, QMC, RNA World

- Lieblingsprojekt

- einheimische Projekte

- Meine Systeme

- AMD Ryzen 7 5800X3D + AMD Radeon RX 6900XT

- BOINC-Statistiken

- Mein Laptop

- Acer Aspire E3 112, Lenovo ThinkPad L570

- Details zu meinem Desktop

- Prozessor

- Ryzen 7 5800X3D

- Mainboard

- MSI X570-A Pro

- Kühlung

- beQuiet DarkRock TF

- Speicher

- 2x 16GB GSkill 1800MHz CL14 @ 1T

- Grafikprozessor

- AMD Radeon 6900XT

- Display

- Samsung C27HG70 @2560*1440 144Hz; EIZO S2411W @1920x1200 60Hz; 52 Zoll Sony KDL-52HX905 @1920*1080

- SSD

- 1TB WD Black SN850 M2 NVME, 512 GB Samsung 850 Pro

- HDD

- 1x 4TB WesternDigital Red

- Optisches Laufwerk

- Pioneer BluRay Brenner

- Soundkarte

- Realtek HD Audio OnBoard (ALC 1220)

- Gehäuse

- noname

- Netzteil

- Seasonic X650 (80+ Gold)

- Tastatur

- Logitech G815 Tactile (brown)

- Maus

- Swiftpoint Z

- Betriebssystem

- Windows 10 Home 64bit

- Webbrowser

- Firefox

traktiere komplett alles mit "Stössen" von bis zu 7bar. Danach sieht der Rechner samt Netzteil usw. aus, als wenn man es gestern aufgebaut hätte.

Hat auch den Vorteil dass unnötige SMDs gleich mit weggestrahlt werden und die Platine sehr neu aussieht.

Gruß,

skell.

HalbeHälfte

Vice Admiral Special

- Mitglied seit

- 30.07.2006

- Beiträge

- 674

- Renomée

- 8

Ja überleg mal! Und ich schreib hier grad auf diesem Rechner und es geht immernoch. Das Rumwuchern mit SMD-Bauteilen ist bei den Taiwanesen echt eine Unart geworden. Die kriegen diese Überproduktionen immernoch nicht in den Griff

Zuletzt bearbeitet:

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

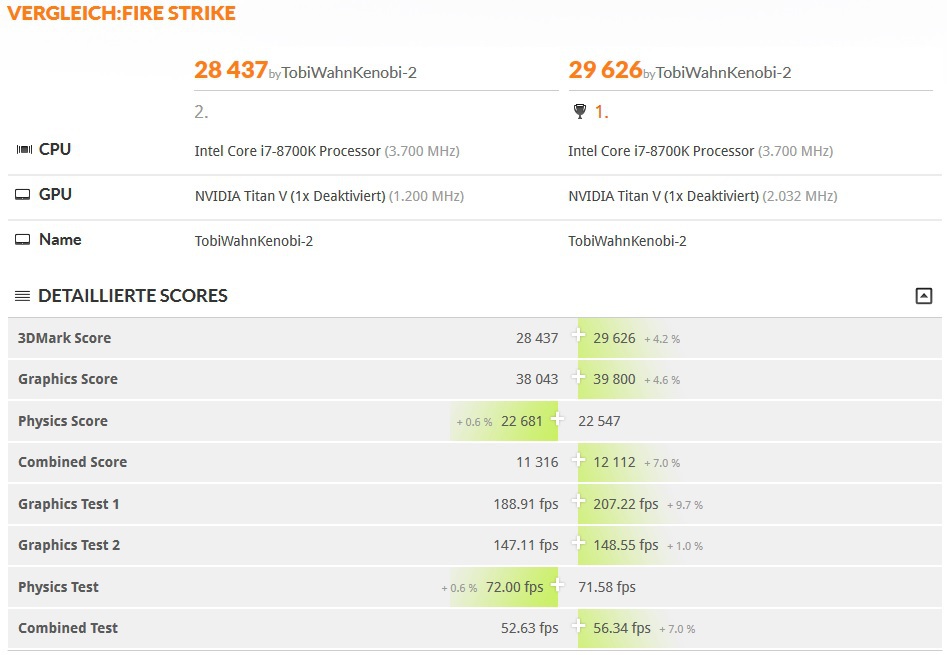

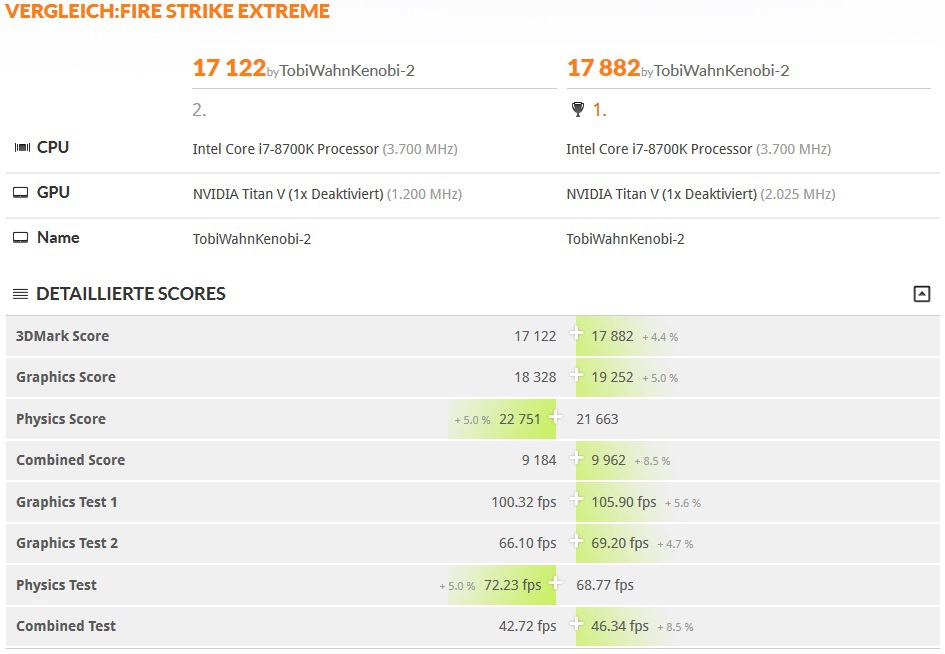

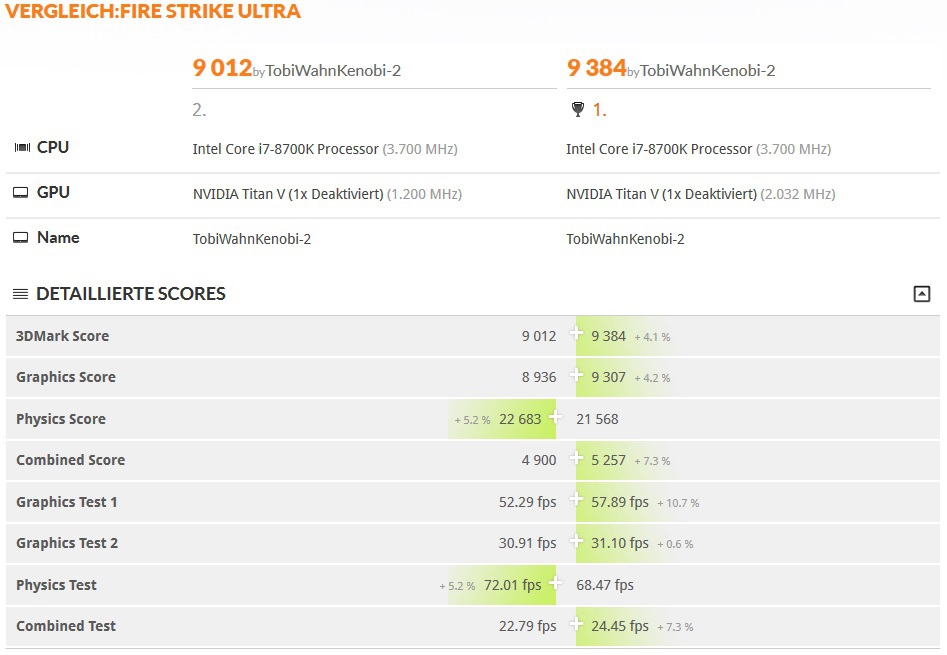

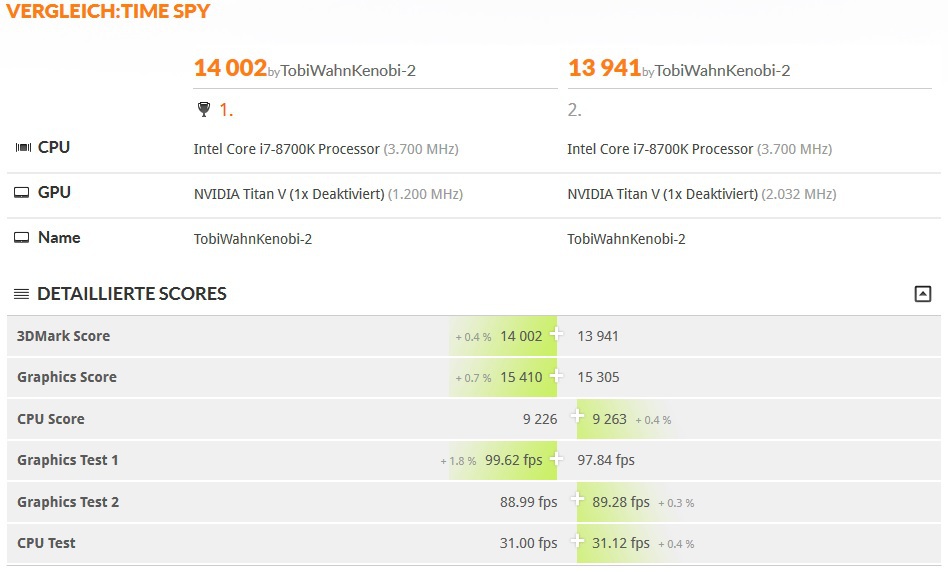

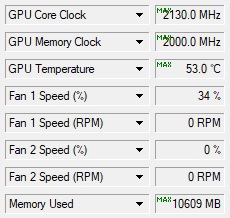

ich lagere hier mal ein paar meiner bisherigen erkenntnisse mit der Geforce RTX 2080 Ti inkl. dezentem OC bis an die kotzgrenze des FE-kühlers zwischen.

das wären ca. 2.1GHz takt, der auch gern mal unter die 2000er marke runterbricht. gemittelt schafft die RTX hier etwa 2050MHz.

(..)

mfg

tobi

das wären ca. 2.1GHz takt, der auch gern mal unter die 2000er marke runterbricht. gemittelt schafft die RTX hier etwa 2050MHz.

------------------------------------------------------

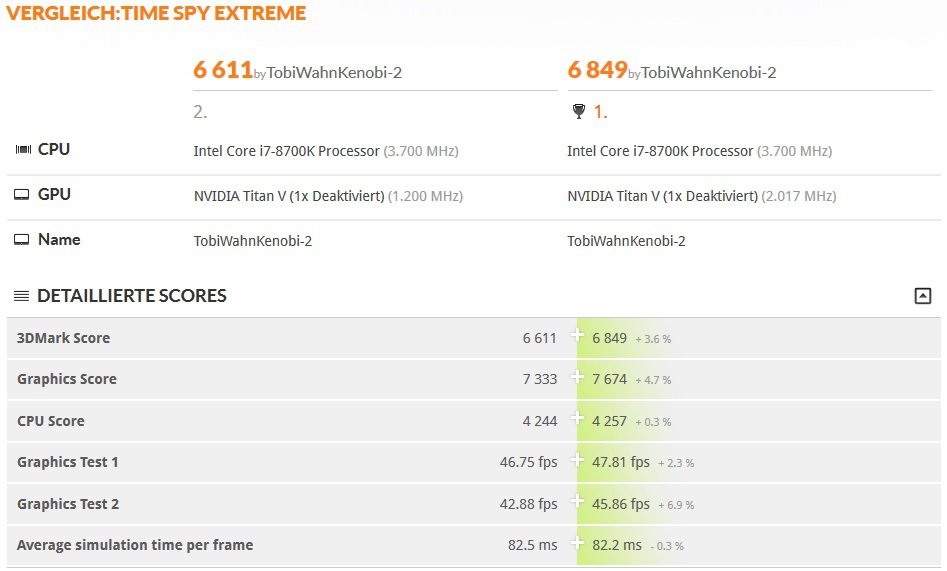

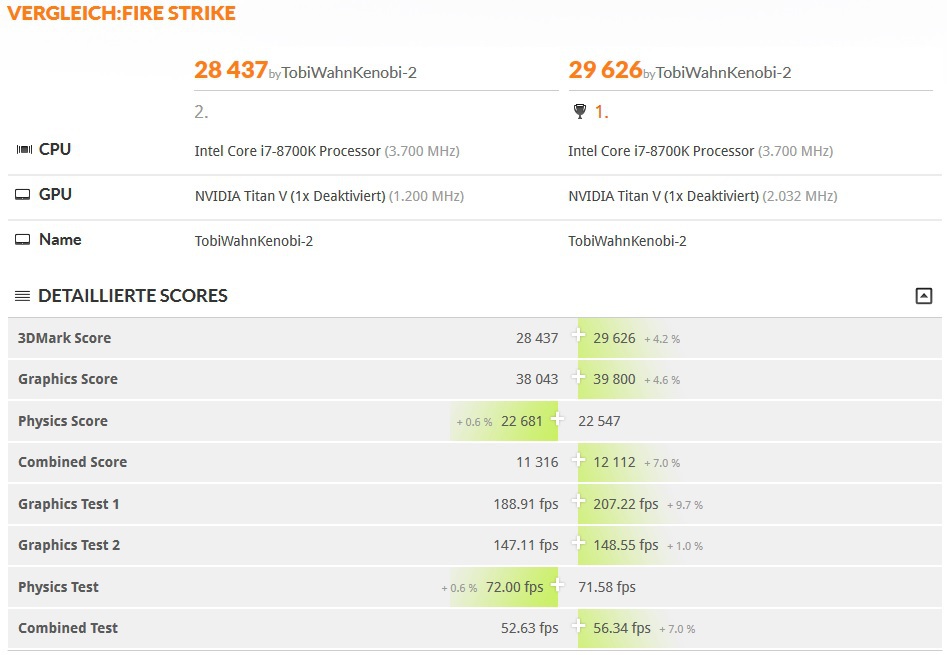

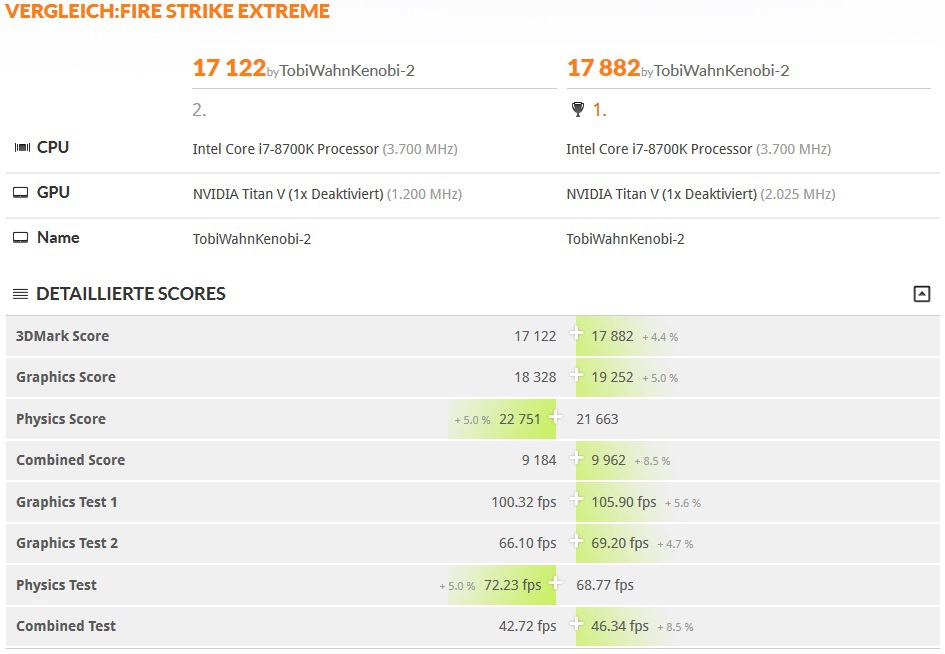

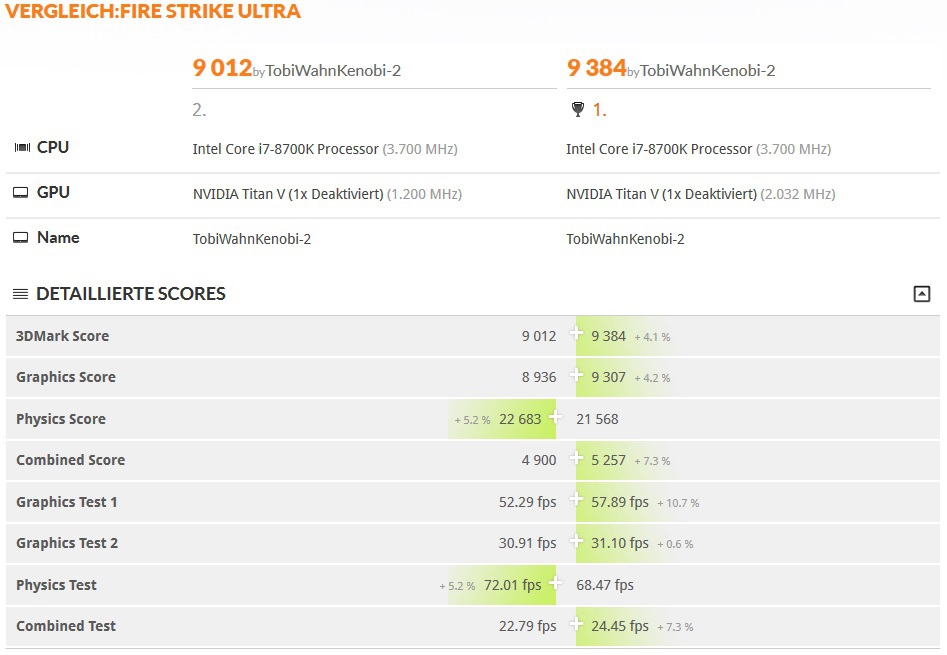

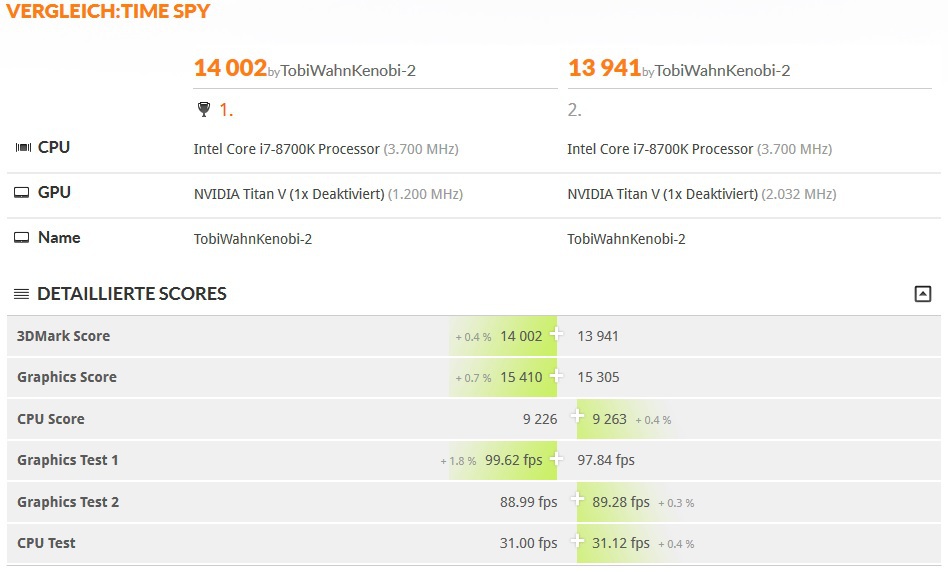

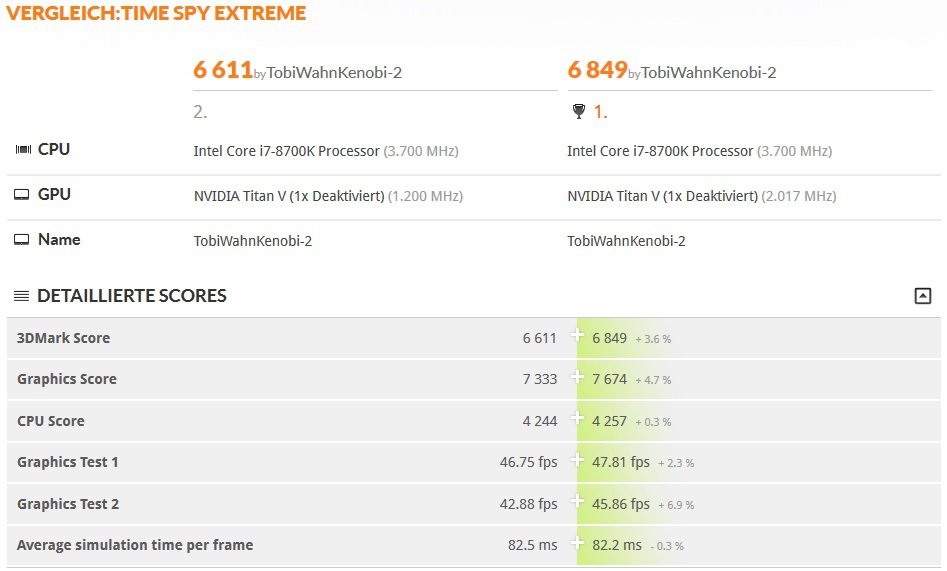

3DMark

NVidia Geforce RTX 2080Ti FE OC (jeweils links im vergleich, die falsche bezeichung ist ein sysinfo-problem)

------------------------------------------------------

Star Wars Battlefront II, UHD, Ultra

2080Ti

62324 frames rendered in 637.969 s

Average framerate : 97.6 FPS

Minimum framerate : 61.3 FPS

Maximum framerate : 121.7 FPS

GV100

110622 frames rendered in 991.812 s

Average framerate : 111.5 FPS

Minimum framerate : 73.4 FPS

Maximum framerate : 200.4 FPS

------------------------------------------------------

Witcher 3 UHD, preset hoch, 4x Hairworks AA

2080Ti

73498 frames rendered in 955.125 s

Average framerate : 76.9 FPS

Minimum framerate : 56.1 FPS

Maximum framerate : 599.8 FPS

GV100

105238 frames rendered in 1417.859 s

Average framerate : 74.2 FPS

Minimum framerate : 54.4 FPS

Maximum framerate : 98.9 FPS

------------------------------------------------------

Far Cry 5

2080Ti

GV100

------------------------------------------------------

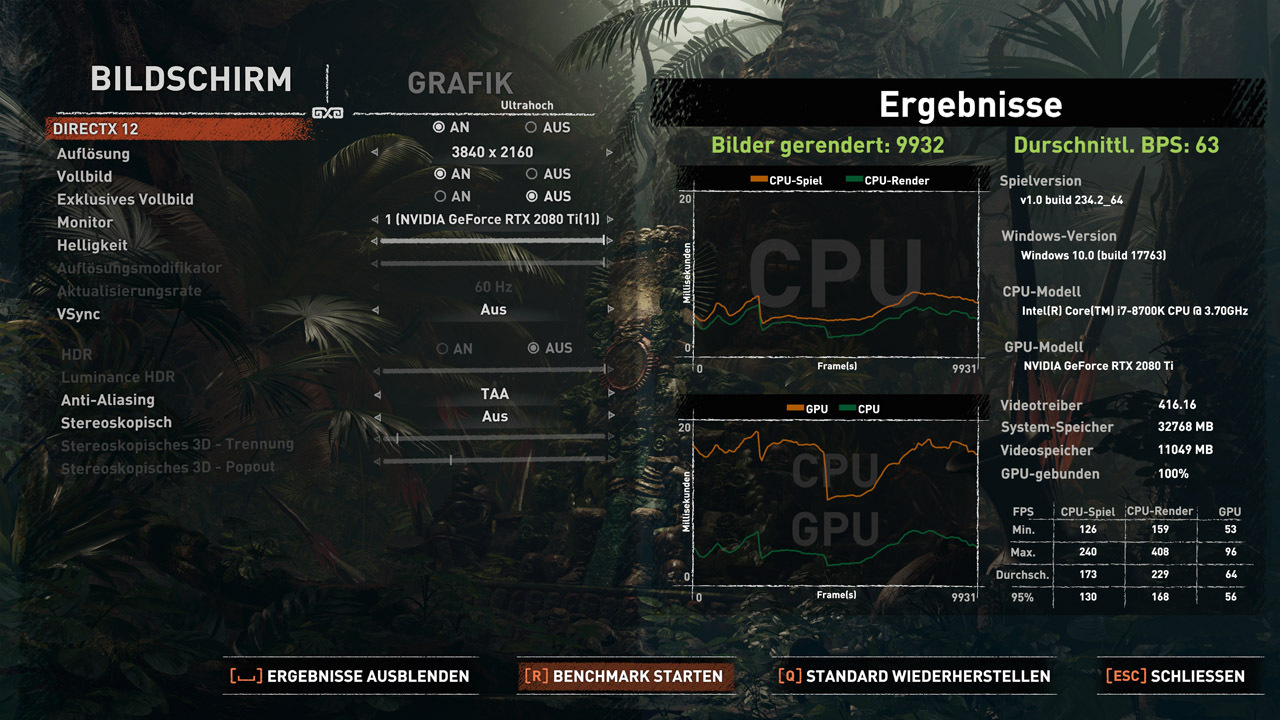

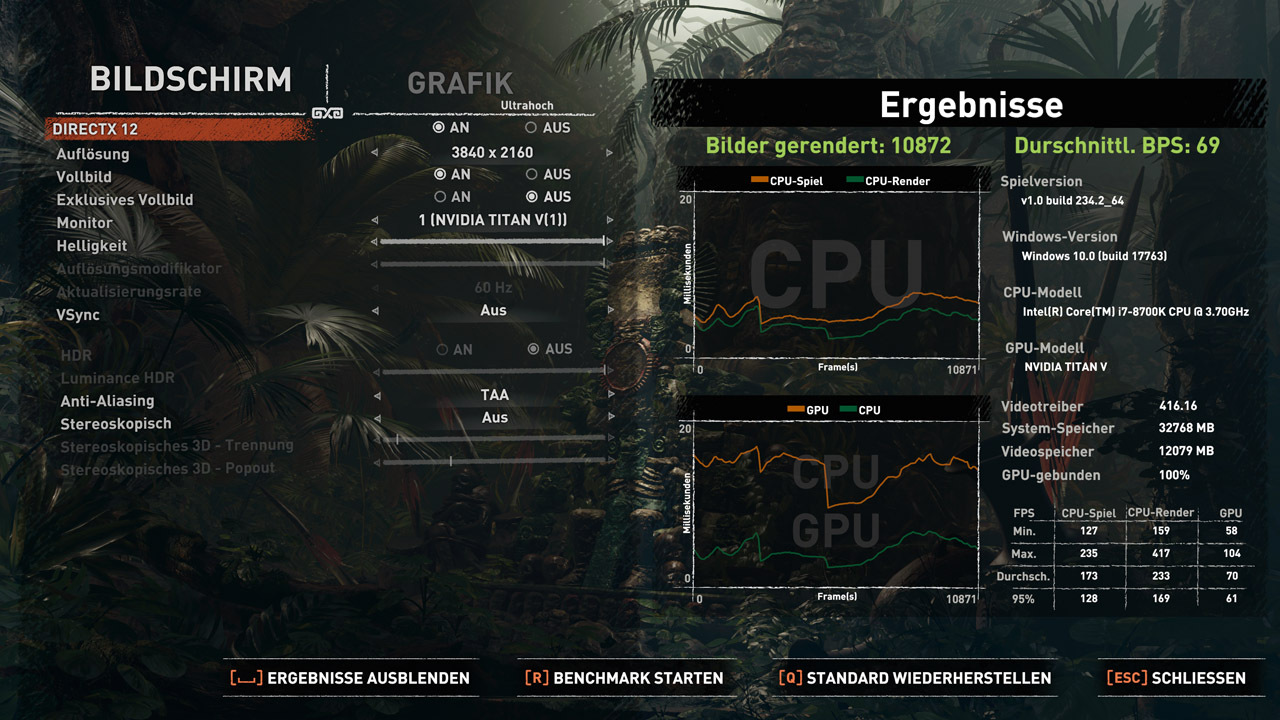

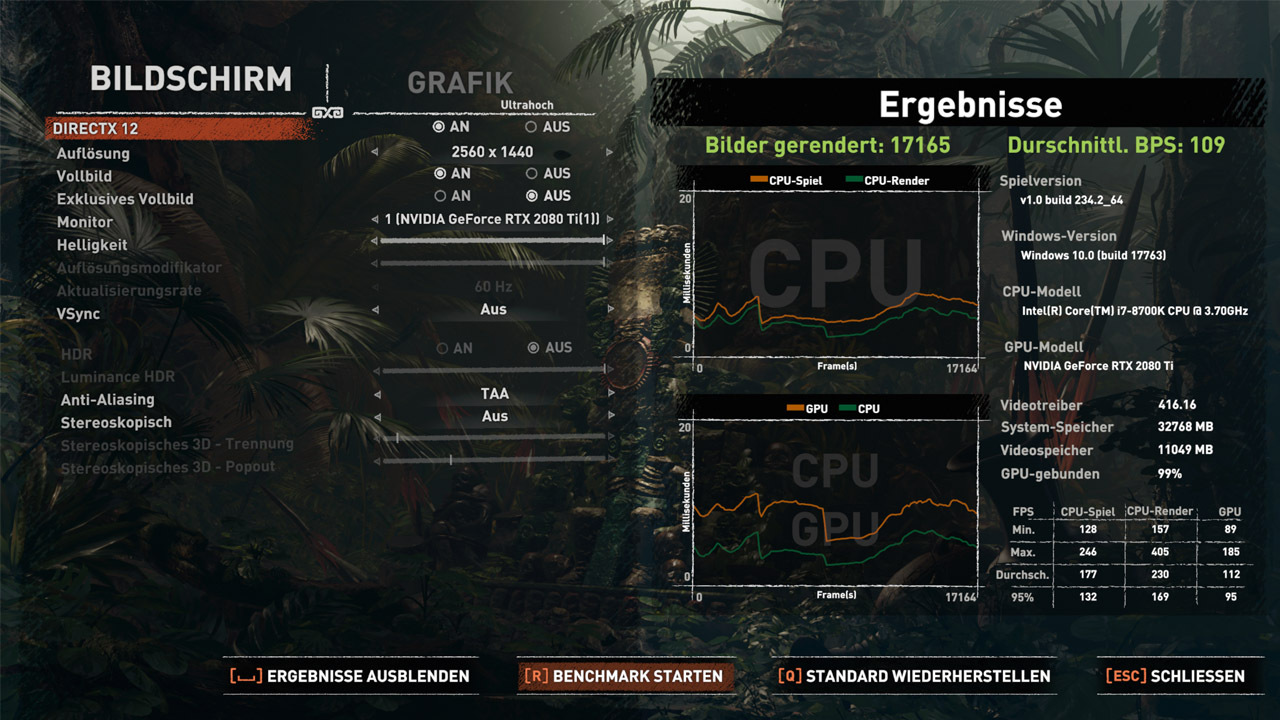

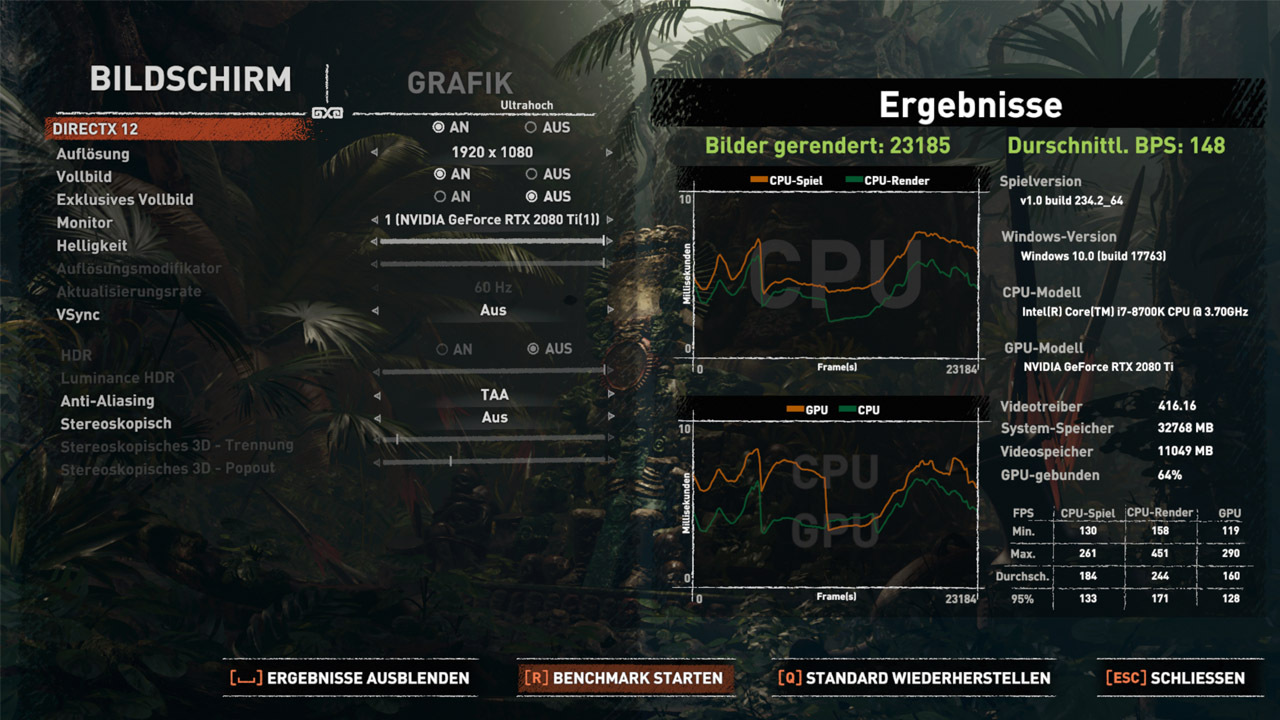

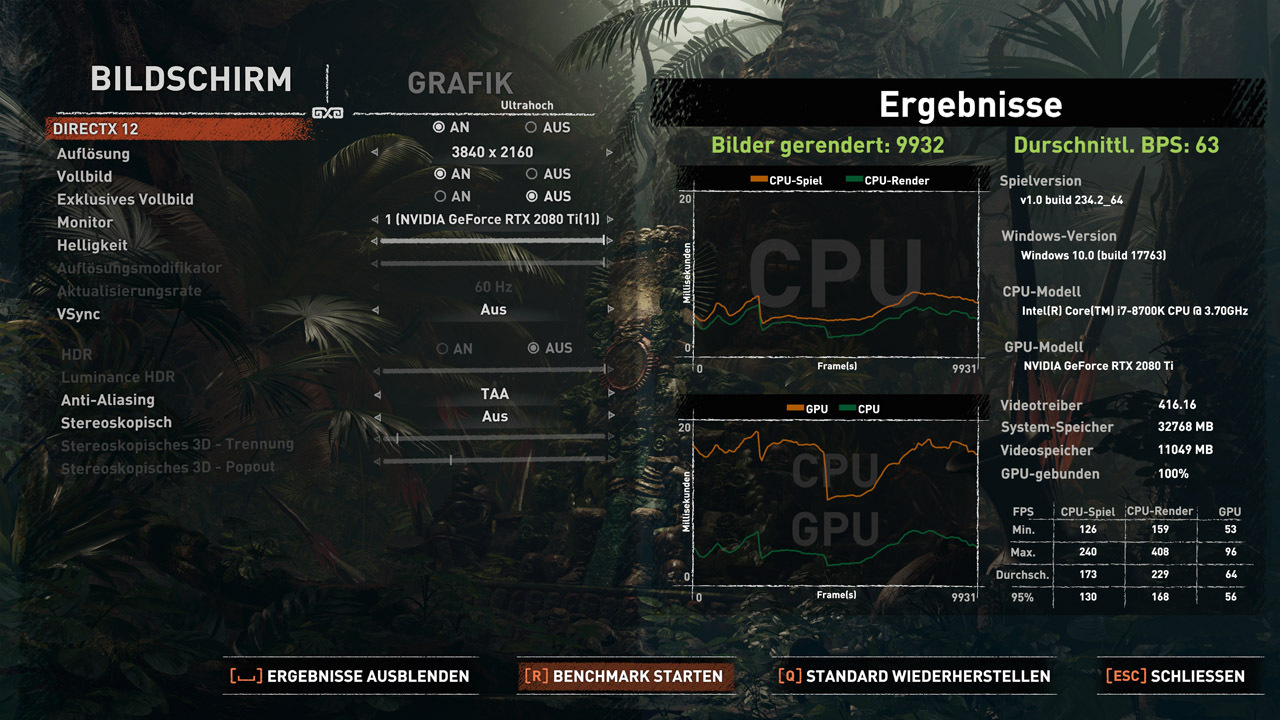

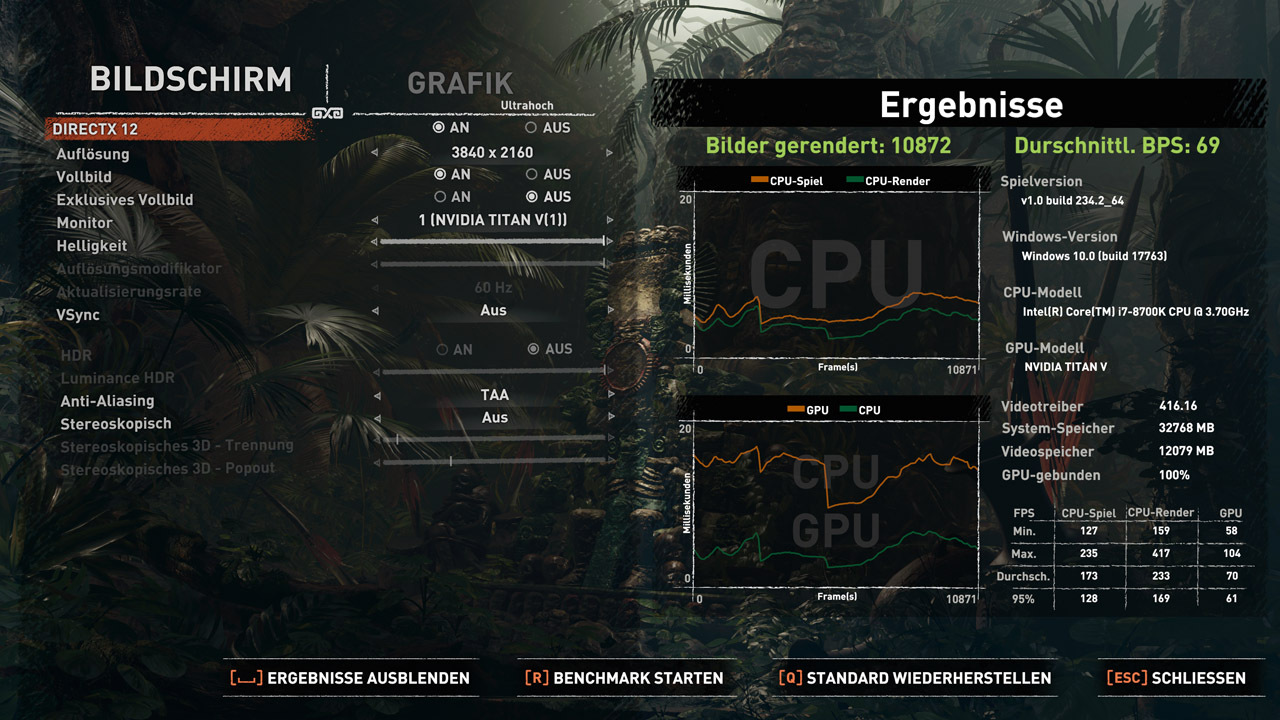

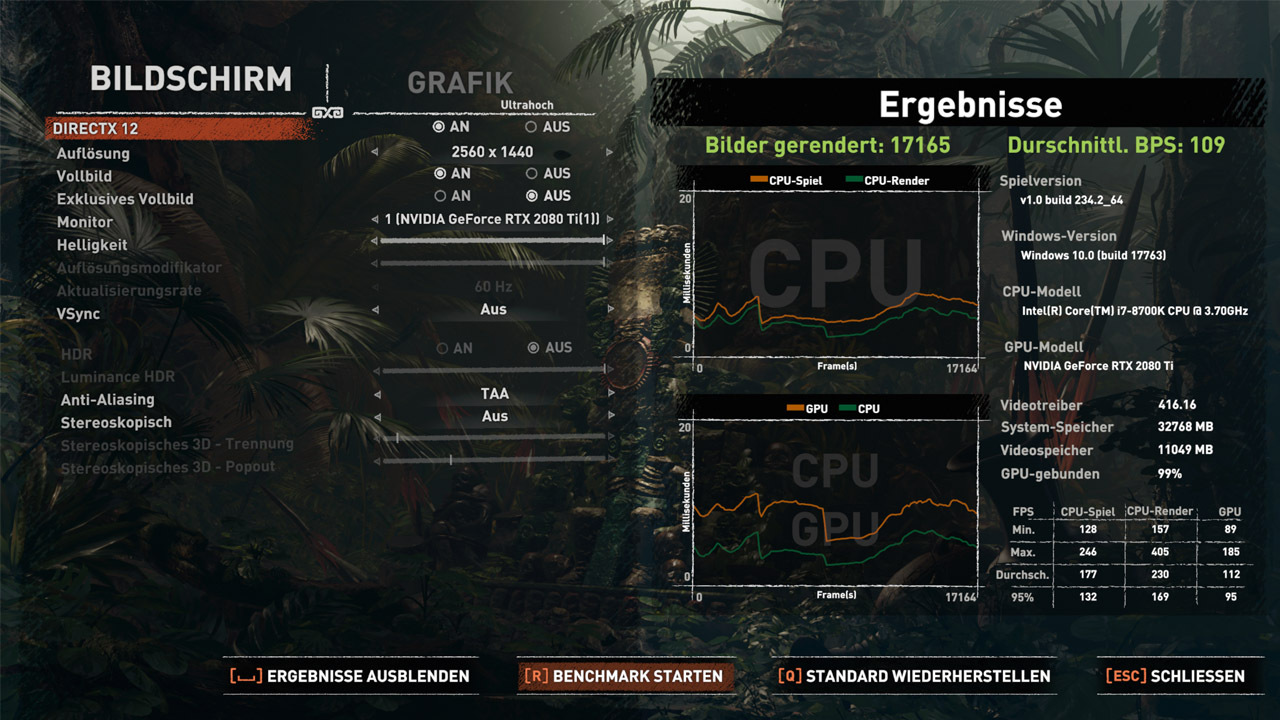

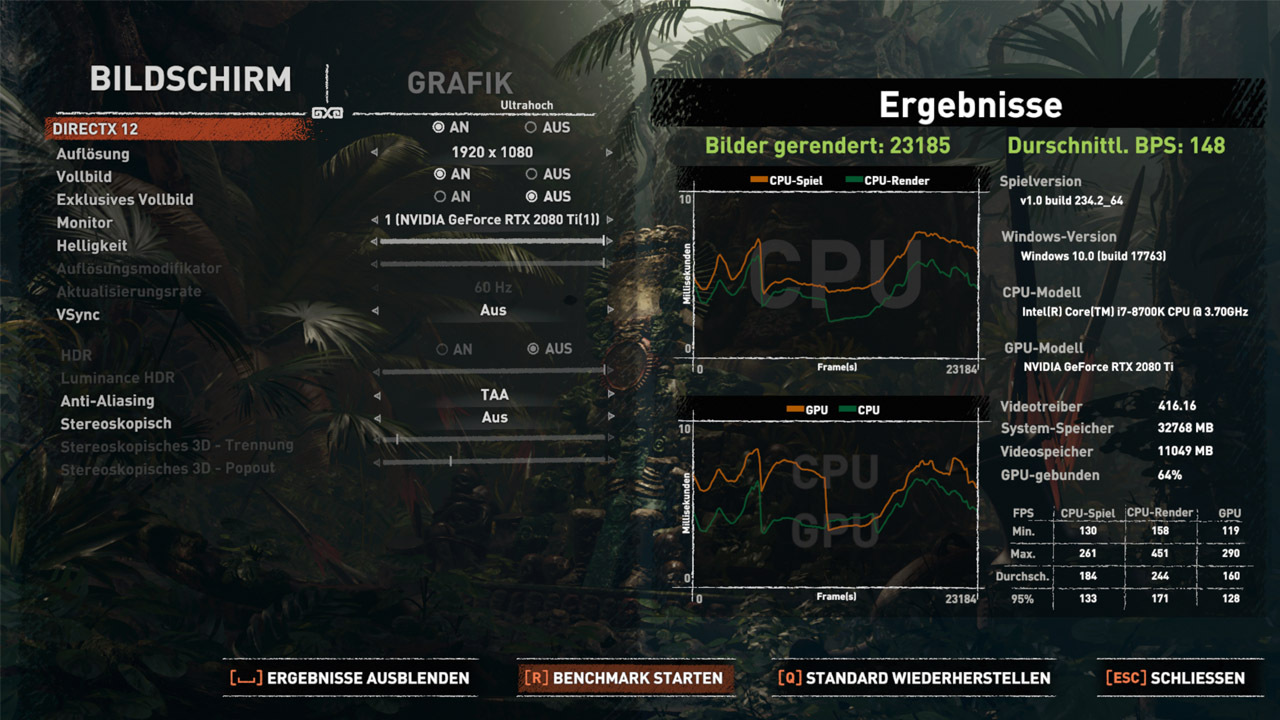

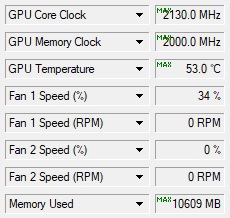

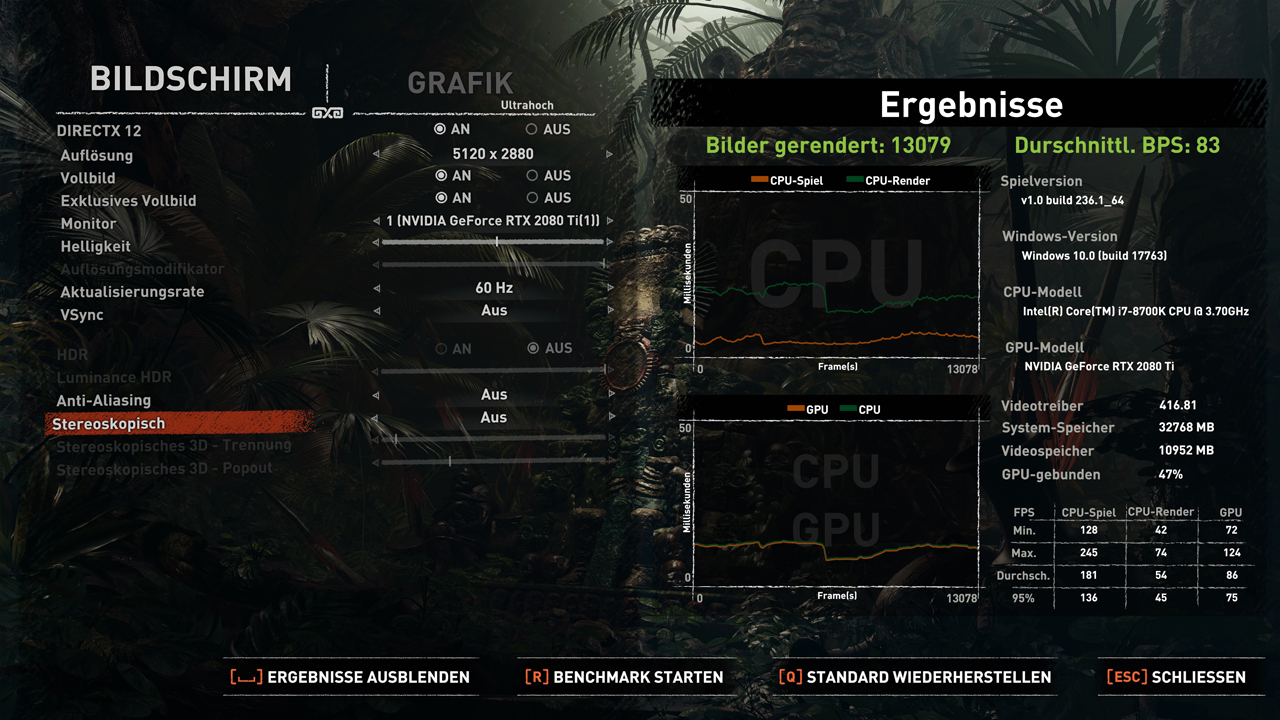

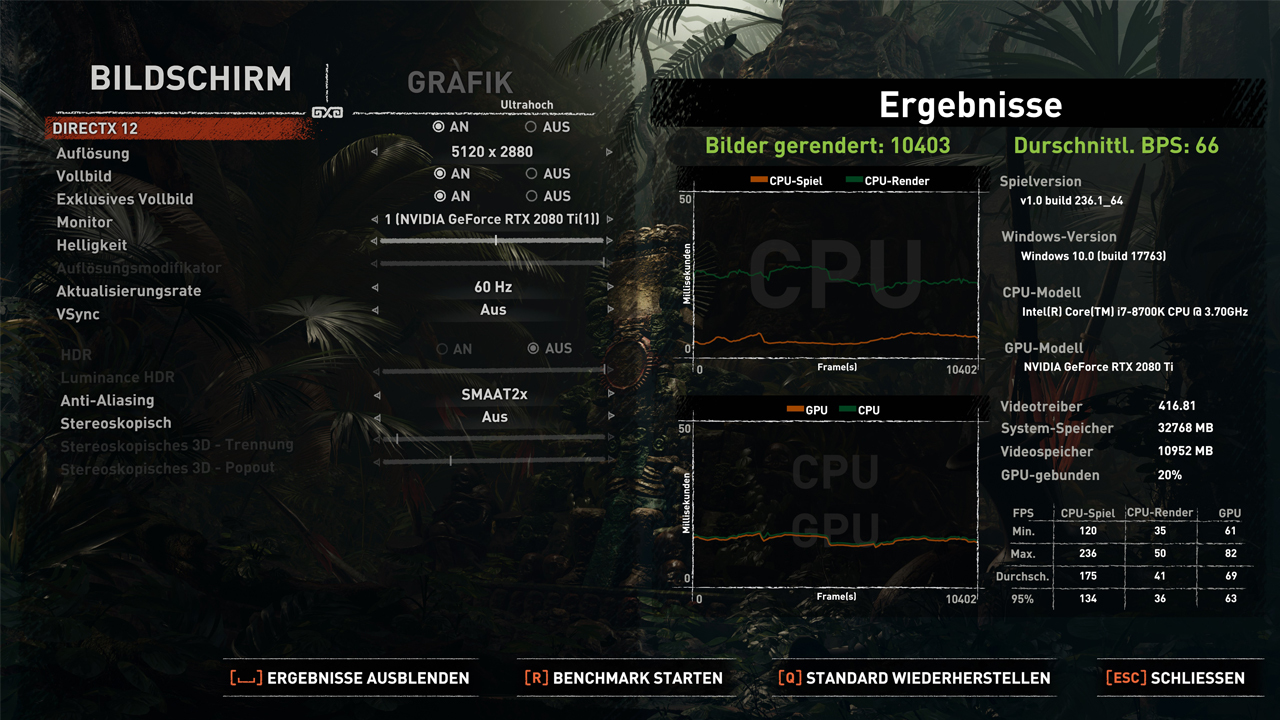

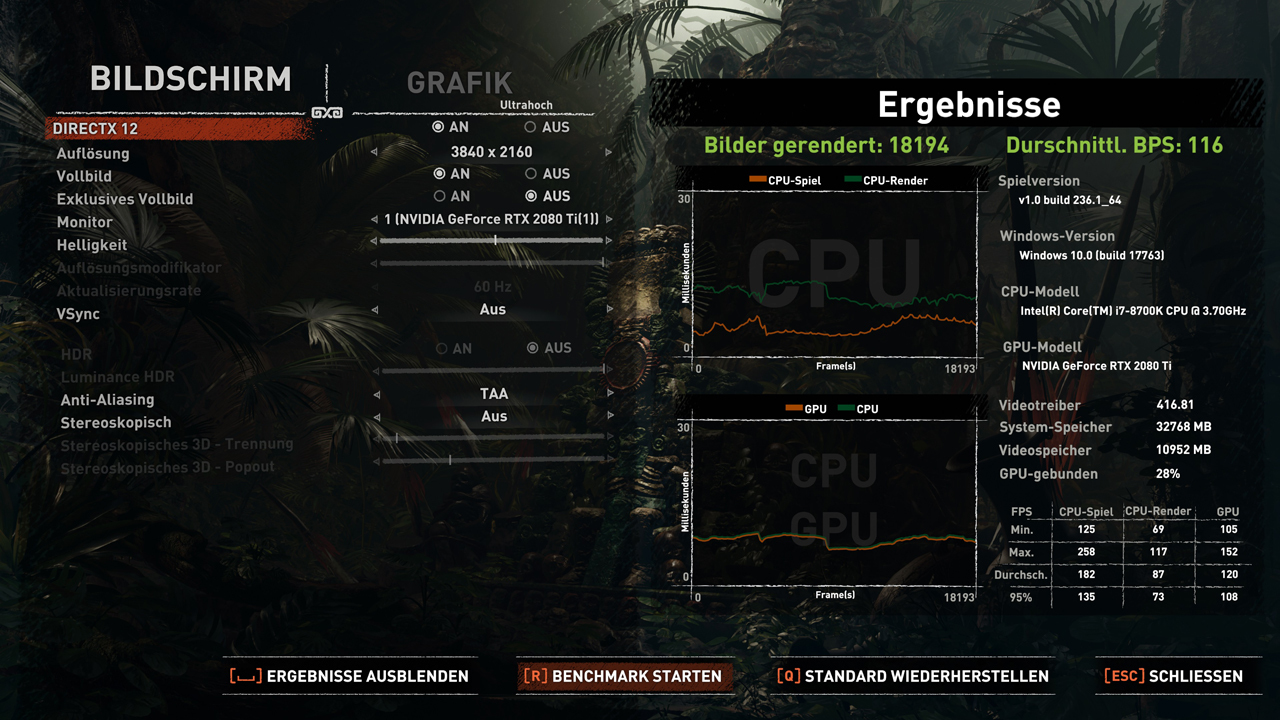

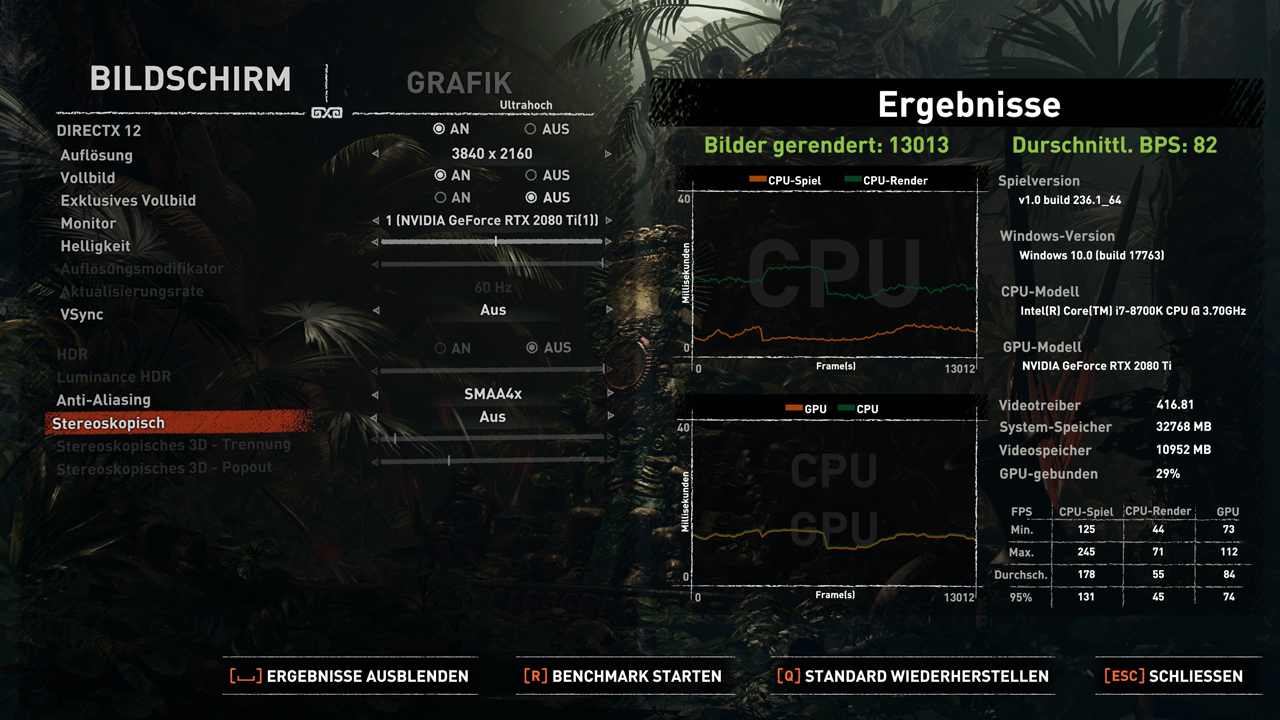

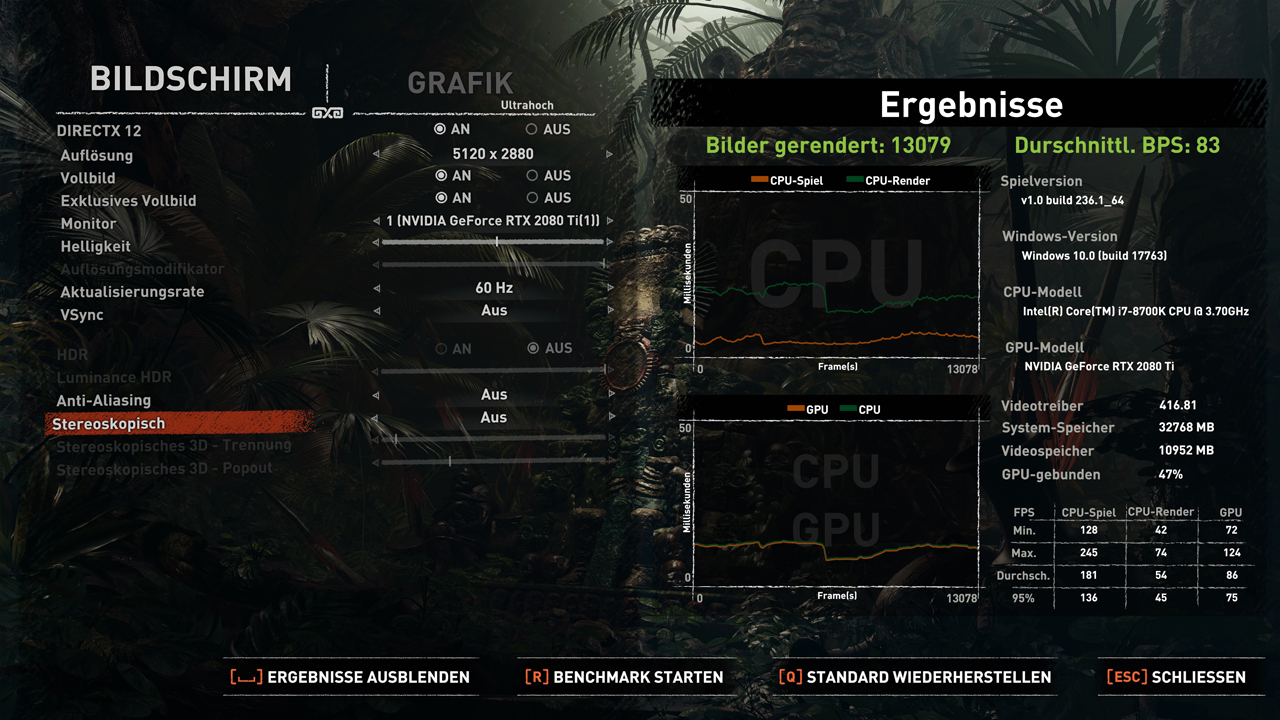

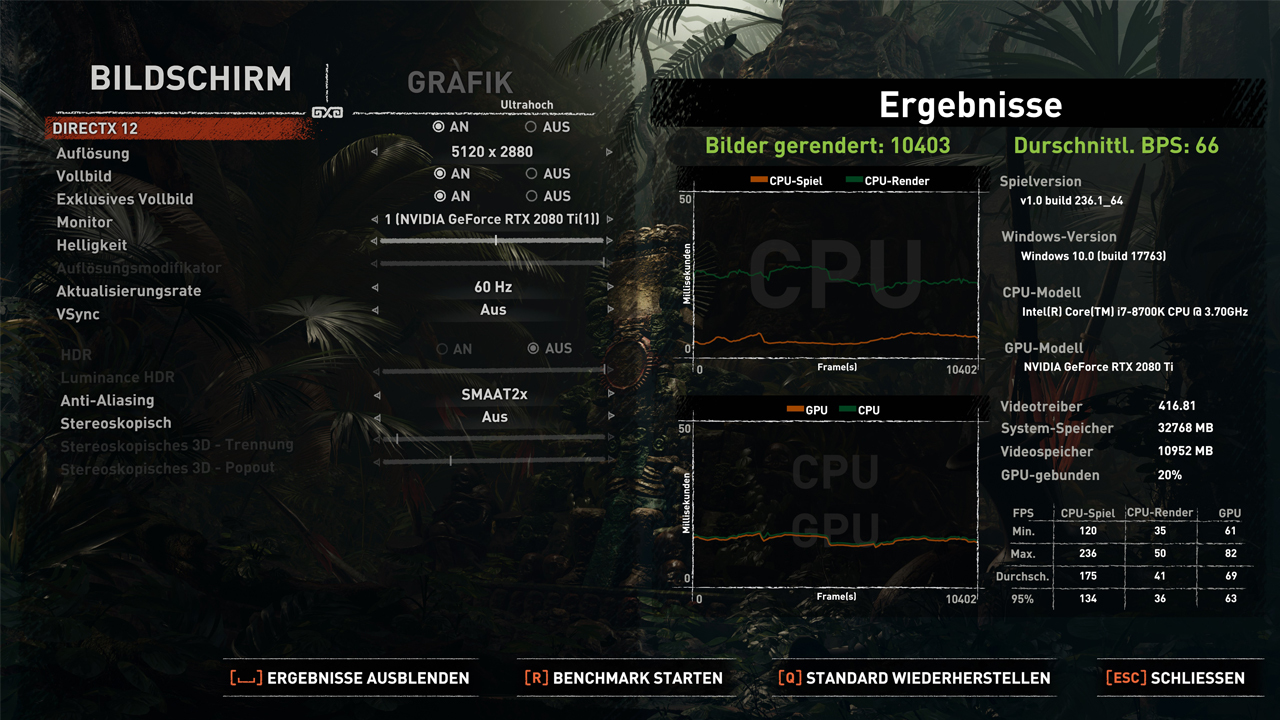

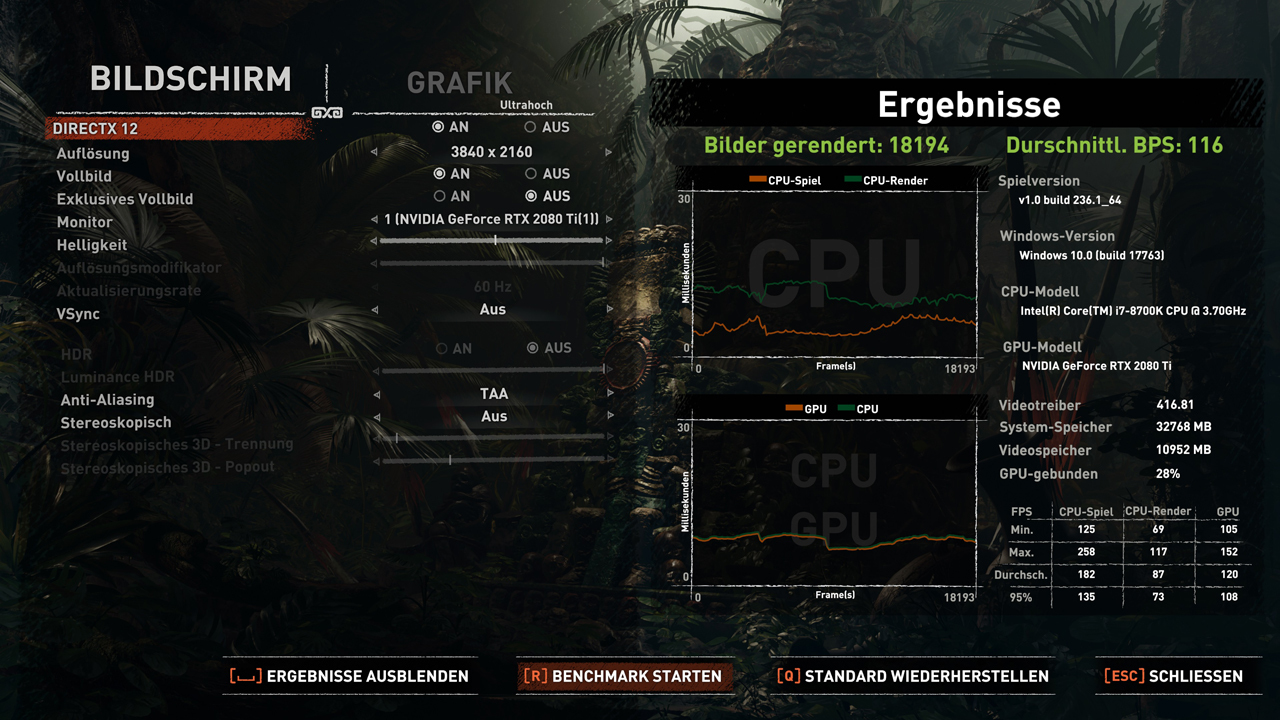

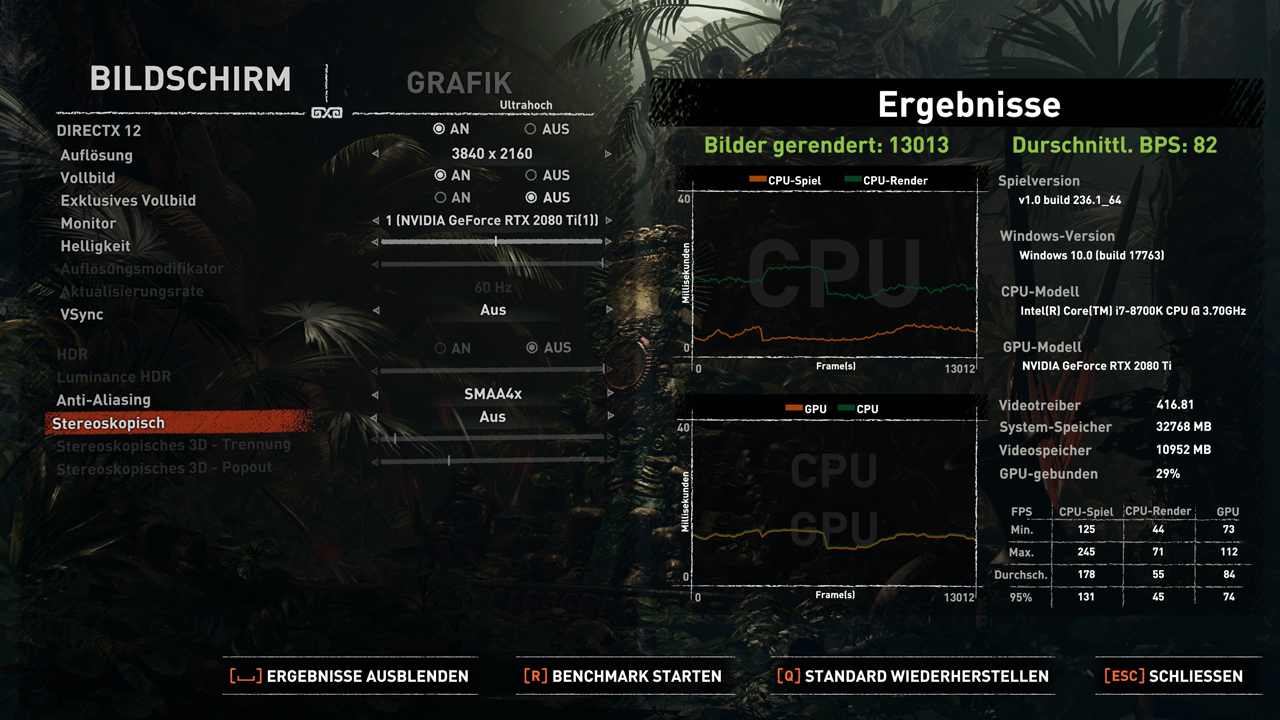

Shadow of the Tomb Raider

UHD, ultrahoch, TAA

WQHD, ultrahoch, TAA

FHD, ultrahoch, TAA

------------------------------------------------------

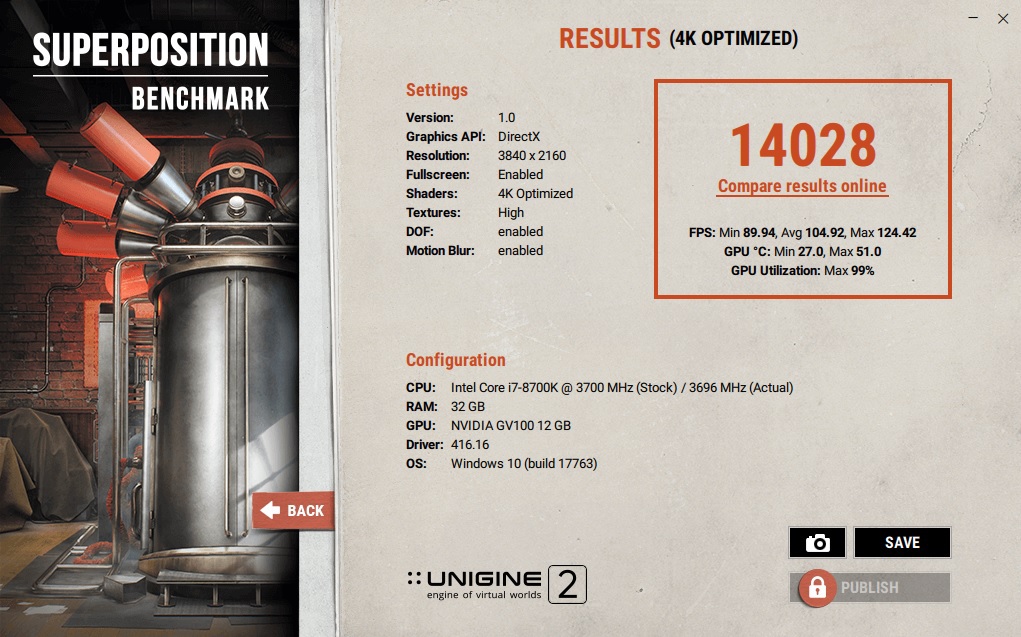

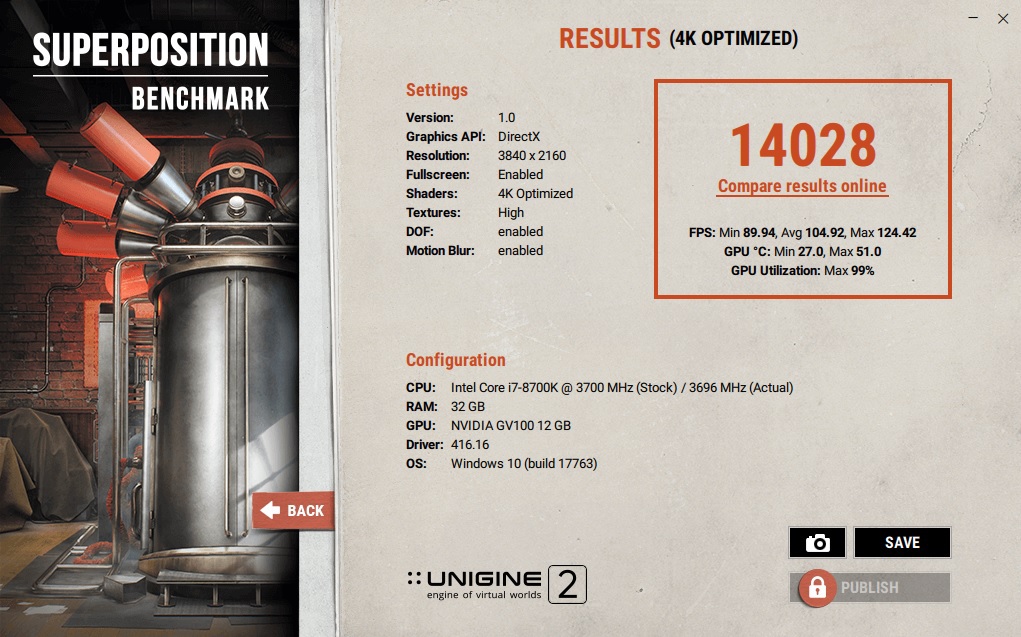

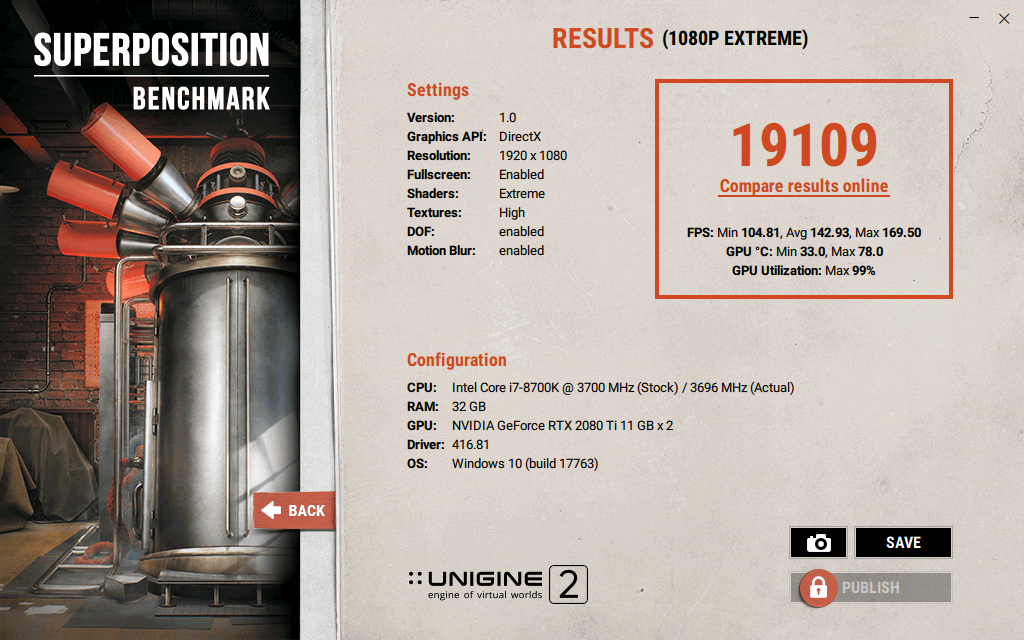

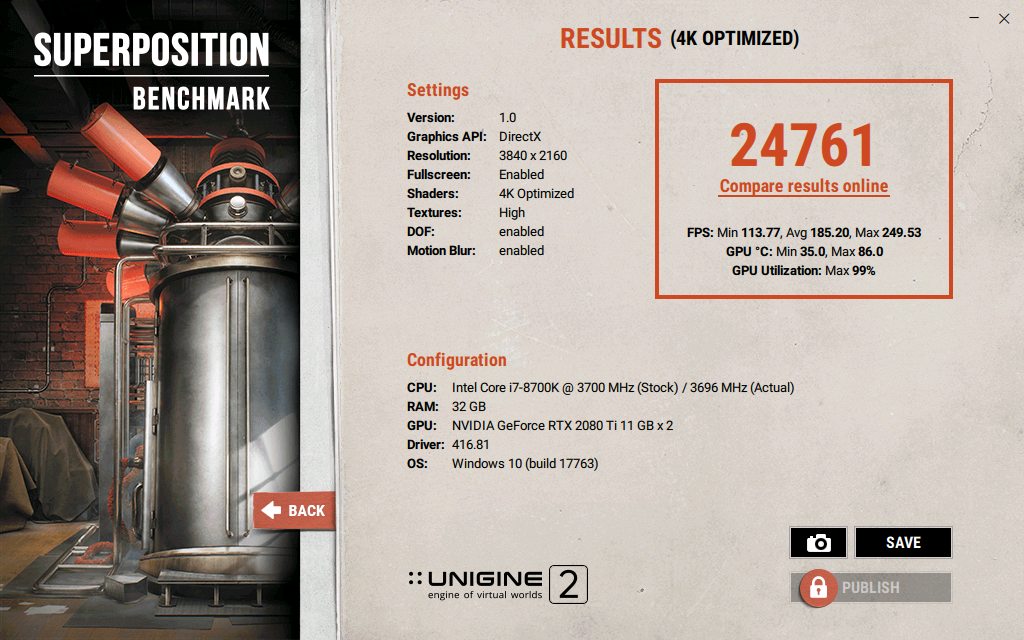

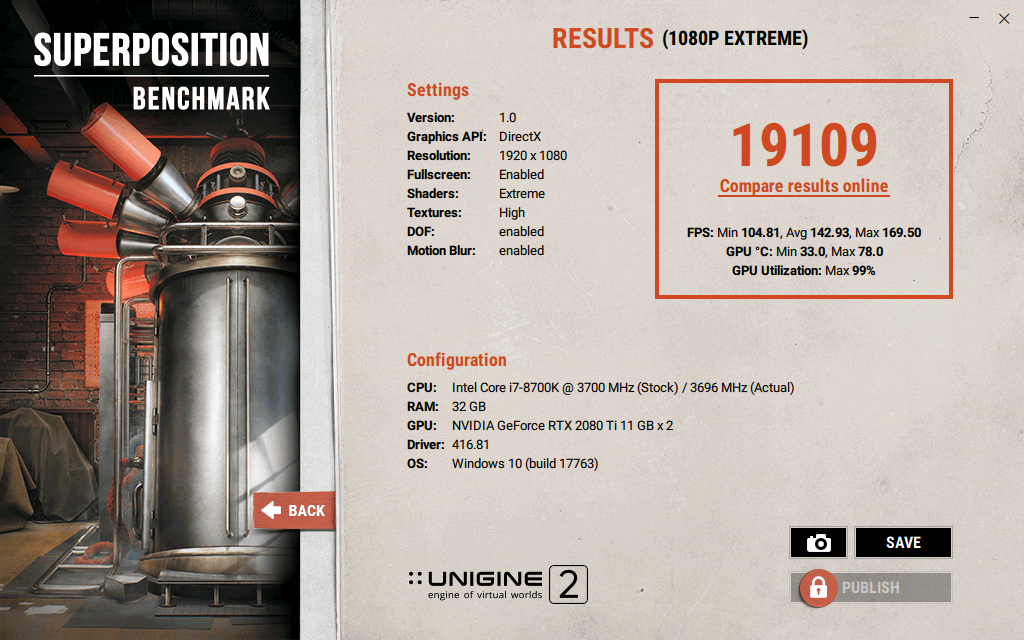

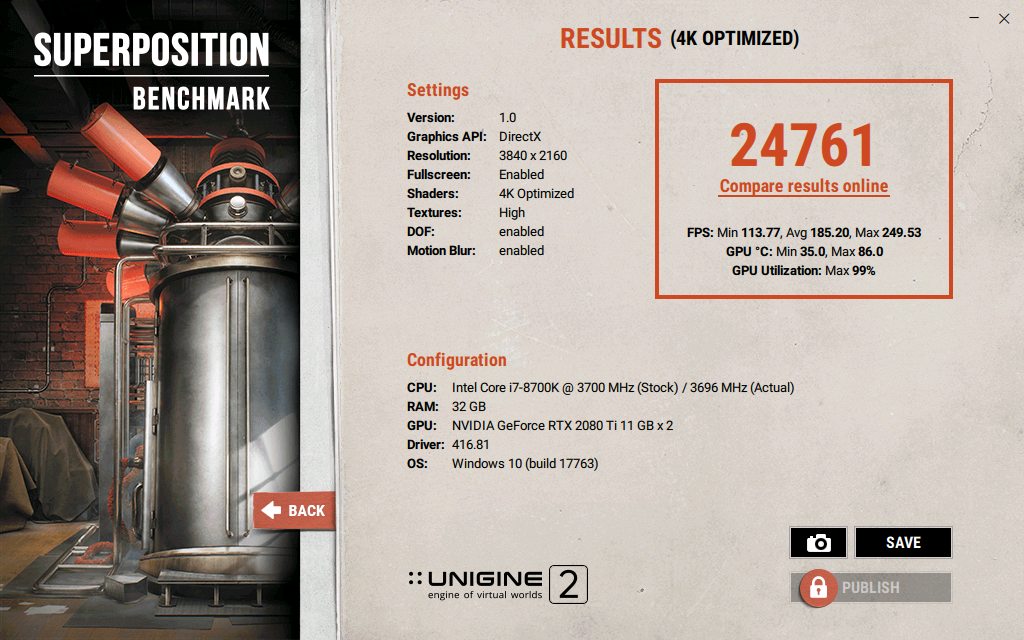

Unigine Super Position

ich ergänze das bestimmt noch..

3DMark

NVidia Geforce RTX 2080Ti FE OC (jeweils links im vergleich, die falsche bezeichung ist ein sysinfo-problem)

------------------------------------------------------

Star Wars Battlefront II, UHD, Ultra

2080Ti

62324 frames rendered in 637.969 s

Average framerate : 97.6 FPS

Minimum framerate : 61.3 FPS

Maximum framerate : 121.7 FPS

GV100

110622 frames rendered in 991.812 s

Average framerate : 111.5 FPS

Minimum framerate : 73.4 FPS

Maximum framerate : 200.4 FPS

------------------------------------------------------

Witcher 3 UHD, preset hoch, 4x Hairworks AA

2080Ti

73498 frames rendered in 955.125 s

Average framerate : 76.9 FPS

Minimum framerate : 56.1 FPS

Maximum framerate : 599.8 FPS

GV100

105238 frames rendered in 1417.859 s

Average framerate : 74.2 FPS

Minimum framerate : 54.4 FPS

Maximum framerate : 98.9 FPS

------------------------------------------------------

Far Cry 5

2080Ti

GV100

------------------------------------------------------

Shadow of the Tomb Raider

UHD, ultrahoch, TAA

WQHD, ultrahoch, TAA

FHD, ultrahoch, TAA

------------------------------------------------------

Unigine Super Position

ich ergänze das bestimmt noch..

(..)

mfg

tobi

Zuletzt bearbeitet:

HalbeHälfte

Vice Admiral Special

- Mitglied seit

- 30.07.2006

- Beiträge

- 674

- Renomée

- 8

Find mich da grad nicht ganz zurecht  In welcher Auflösung lief 3dmark? Der Journalist Schilling findet irgendwie nicht eine Einstellung wo die V besser in 3dmark sein kann als die 2080Ti FE...

In welcher Auflösung lief 3dmark? Der Journalist Schilling findet irgendwie nicht eine Einstellung wo die V besser in 3dmark sein kann als die 2080Ti FE...

In welcher Auflösung lief 3dmark? Der Journalist Schilling findet irgendwie nicht eine Einstellung wo die V besser in 3dmark sein kann als die 2080Ti FE...

In welcher Auflösung lief 3dmark? Der Journalist Schilling findet irgendwie nicht eine Einstellung wo die V besser in 3dmark sein kann als die 2080Ti FE...TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

die schnullermarks liefen in den jeweiligen standardsettings. im far cry ist mir ein fehler unterlaufen, den ich jetzt erst sehe.. auflösungsskalierung steht auf 1.2 -> fixed!

btw,

die werte im vergleich sind die höchsten, die ich mit der jeweiligen karte "auf die schnelle" erreichen konnte. bei der RTX freilich erstmal die augenscheinlich höchste taktung. dass da noch mehr geht, will ich nicht ausschliessen. dass der speicher doch nicht soviel kann, wird sich ggf. auch noch zeigen. die karte ist noch zu neu als dass ich sie gut kennen würde. also gibts bei beiden karten roundabout 2GHz. bei der RTX mit ausreissern richtung 2.1GHz und auch darüber hinaus; bei der GV100 tendenziell eher richtung 1.9GHz herunter. bei geringer auslastung (FHD, WQHD) taktet

die RTX bis 2150MHz hoch; titan v bis 2040MHz. bei höherem load in form von UHD auflösungen erreicht die RTX oft noch 2050MHz, wo titan v schon bei 1950MHz ist. das ist halt ein fetterer chip und insofern nicht verwunderlich. aber auch RTX kann unter die 2GHz herunterbrechen, aber man merkt beim testen, dass NVidia sich gedanken gemacht hat. die budgets reichen einfach nicht, um mit 12nm "min 2GHz" auf die packung zu schreiben. es gibt immer situationen, wo die schönen runden takte nicht gehalten werden können.

fraglich ist, ob die testerei nicht vergebliche liebesmüh ist, da sich ohne OSD nicht erfühlen lässt, ob das spiel jetzt auf RTX oder TV abläuft. wo mal die eine, mal die andere schneller oder langsamer ist, ist die differenz nicht der rede wert. für spiele scheinen beide erstmal gleichschnell.

evtl. wird sich noch einiges ändern, wenn irgendwann mal spiele erscheinen, die die tensorcores mitbeanspruchen. da könnten sich übertriebene frequenzen aufgrund höherer auslastung natürlich negativ bemerkbar machen. das selbe gilt für angeflanschtes raytracing, sofern irgendwann verfügbar.

nvidia hat mit der leistungsfähigkeit gut balanciert. was deren FE-kühlsystem wegschaufelt ist - ungeachtet der geräuschkulisse - schon beachtlich. klar, die frequenzen fallen niedriger aus, wenn man mit erträglicher geräuschkulisse spielt und das kostet dann die letzten 5-10% leistung, aber in alten spielen ist davon genug vorhanden, um mit UHD60 zu laufen. templimit lässt sich mit aufgerissener drehzahl nahezu eleminieren und ich behaupte jetzt, dass ein wasserkühler zwar die ohren schont, aber nichts spruchreifes auf den takt mehr drauflegen kann. für höhere performance müsste das powerlimit erhöht und die TBP (typical board power) -überwachung abgeschaltet werden. letzteres ist nicht möglich; ersteres geht. das vernichtet allerdings die garantie (crossflash/shuntmod) und mit pech auch die karte. ja, das teil ist gut ausbalanciert.. takte, in denen aus 45fps dann 60fps im neuesten assassins creed werden, sind mit der karte natürlich nicht erreichbar. dazu müsste ein skupelloser user mit trockeneis und lötkolben a la kingpin handtieren; nur wir wollen ja spielen und nicht vorsätzlich elektroschrott produzieren.

die anzeige auf meinem leistungsmessgerät (gesamtsystem) schlug nicht unerwartet aus. unter volllast von prozessor und grafikkarte etwas über 520W peak, wohlgemerkt alle takte voll ausgefahren (für benchmarks u. gemessen beim benchen).

(..)

mfg

tobi

btw,

die werte im vergleich sind die höchsten, die ich mit der jeweiligen karte "auf die schnelle" erreichen konnte. bei der RTX freilich erstmal die augenscheinlich höchste taktung. dass da noch mehr geht, will ich nicht ausschliessen. dass der speicher doch nicht soviel kann, wird sich ggf. auch noch zeigen. die karte ist noch zu neu als dass ich sie gut kennen würde. also gibts bei beiden karten roundabout 2GHz. bei der RTX mit ausreissern richtung 2.1GHz und auch darüber hinaus; bei der GV100 tendenziell eher richtung 1.9GHz herunter. bei geringer auslastung (FHD, WQHD) taktet

die RTX bis 2150MHz hoch; titan v bis 2040MHz. bei höherem load in form von UHD auflösungen erreicht die RTX oft noch 2050MHz, wo titan v schon bei 1950MHz ist. das ist halt ein fetterer chip und insofern nicht verwunderlich. aber auch RTX kann unter die 2GHz herunterbrechen, aber man merkt beim testen, dass NVidia sich gedanken gemacht hat. die budgets reichen einfach nicht, um mit 12nm "min 2GHz" auf die packung zu schreiben. es gibt immer situationen, wo die schönen runden takte nicht gehalten werden können.

fraglich ist, ob die testerei nicht vergebliche liebesmüh ist, da sich ohne OSD nicht erfühlen lässt, ob das spiel jetzt auf RTX oder TV abläuft. wo mal die eine, mal die andere schneller oder langsamer ist, ist die differenz nicht der rede wert. für spiele scheinen beide erstmal gleichschnell.

evtl. wird sich noch einiges ändern, wenn irgendwann mal spiele erscheinen, die die tensorcores mitbeanspruchen. da könnten sich übertriebene frequenzen aufgrund höherer auslastung natürlich negativ bemerkbar machen. das selbe gilt für angeflanschtes raytracing, sofern irgendwann verfügbar.

nvidia hat mit der leistungsfähigkeit gut balanciert. was deren FE-kühlsystem wegschaufelt ist - ungeachtet der geräuschkulisse - schon beachtlich. klar, die frequenzen fallen niedriger aus, wenn man mit erträglicher geräuschkulisse spielt und das kostet dann die letzten 5-10% leistung, aber in alten spielen ist davon genug vorhanden, um mit UHD60 zu laufen. templimit lässt sich mit aufgerissener drehzahl nahezu eleminieren und ich behaupte jetzt, dass ein wasserkühler zwar die ohren schont, aber nichts spruchreifes auf den takt mehr drauflegen kann. für höhere performance müsste das powerlimit erhöht und die TBP (typical board power) -überwachung abgeschaltet werden. letzteres ist nicht möglich; ersteres geht. das vernichtet allerdings die garantie (crossflash/shuntmod) und mit pech auch die karte. ja, das teil ist gut ausbalanciert.. takte, in denen aus 45fps dann 60fps im neuesten assassins creed werden, sind mit der karte natürlich nicht erreichbar. dazu müsste ein skupelloser user mit trockeneis und lötkolben a la kingpin handtieren; nur wir wollen ja spielen und nicht vorsätzlich elektroschrott produzieren.

die anzeige auf meinem leistungsmessgerät (gesamtsystem) schlug nicht unerwartet aus. unter volllast von prozessor und grafikkarte etwas über 520W peak, wohlgemerkt alle takte voll ausgefahren (für benchmarks u. gemessen beim benchen).

(..)

mfg

tobi

Zuletzt bearbeitet:

Alyva

Vice Admiral Special

- Mitglied seit

- 12.01.2008

- Beiträge

- 712

- Renomée

- 6

- Details zu meinem Desktop

- Prozessor

- AMD Athlon 64 3500+ Newcastle

- Mainboard

- K8N SLI Platinum

- Kühlung

- Boxed Variante

- Speicher

- MDT 2* 1 GB PC400 CL2

- Grafikprozessor

- Geforce 6800 GT Ultra

- Display

- 17" AOC 1280*1024

- HDD

- WD 360 GD / ST3200822A

- Optisches Laufwerk

- Toshiba DVD-Rom SD-M1912

- Soundkarte

- Soundblaster Audigy

- Netzteil

- 380 Watt

- Betriebssystem

- Windows XP

- Webbrowser

- Maxthon

Warum hast du dir die Karten denn angetan? Ich meine es war nach den Leaks schon klar, dass es sich nur um ein Volta-Derivat handeln würde. Dementsprechend sind ja auch die Ergebnisse in diesem Bereich. Ich muss aber zugeben ich hatte das Design eher in 7nm erwartet, damit Nvidia hier die DX11 Schwäche karschieren kann und um sich von der T-V auch abzusetzen und zwar um die zu erwartenden ca. zusätzlichen 40% (Plus Minus 5%). Natürlich könnte ich es verstehen, wenn es dir einfach zu langweilig war auf den Prozess zu warten

HalbeHälfte

Vice Admiral Special

- Mitglied seit

- 30.07.2006

- Beiträge

- 674

- Renomée

- 8

Weil er nicht erst gestern gemerkt hat, daß man nen Shice daruf geben kann was irgendwelche IT-Pseudojournalisten testen und je größer und bekannter die Portale sind, desto schlimmer ist es.Warum hast du dir die Karten denn angetan?

Darkearth21

Fleet Captain Special

- Mitglied seit

- 30.01.2003

- Beiträge

- 289

- Renomée

- 23

- Standort

- Hannover

- Details zu meinem Desktop

- Prozessor

- Ryzen 3800X @ Auto OC + Ryzen 3900X @ Stock

- Mainboard

- Asus Crosshair 6 Hero + MSI Unify X570

- Kühlung

- Alphacool Eisbaer Modded + Wraith Prism

- Speicher

- 2 x 16GB E-Dies @ 3733CL16 + 2 x 16GB E-Dies @3733CL16

- Grafikprozessor

- MSI GTX 1080Ti Gaming X 11G @ 1760 / 5900 MHz @ 0.879v + Radeon RX570 @ Stock

- Display

- BenQ 3203R + BenQ XL2730Z 27" 144Hz

- SSD

- Samsung Evo 840 256GB, Crucial MX200 500GB Crucial MX 500 1TB + Samsung Evo 850 256GB

- HDD

- 1x Extern 1TB WD Green im Hardcase + 1x 2TB Toschiba

- Optisches Laufwerk

- keines mehr

- Gehäuse

- NZXT s340 Elite White + Nokia 3310 Oldschool Tower

- Netzteil

- Corsair RM850X Weiß + bQuiet! DPP 550w

- Betriebssystem

- Win10 64 ProN + Win 64 Pro

- Webbrowser

- Firefox | Nightly

Tobi, kannst du mir mal einen gefallen tun und dir den Nvidia Inspector runterladen?

Da gibt es dann unter "Other" einen Reiter wo dann "Nvidia Quality Upscaling" zu sehen ist. Dieser ist normal auf "OFF" kannst du den mal auf ON machen und mal testen ob die Einstellung bei der Turing etwas bewirkt?

Ich habe es auf meiner Pascal mal getestet und kann keinen Unterschied bei niedrigen Auflösungen erkennen. Wäre interessant ob es bei Turing eine Änderung hervorruft.

Da gibt es dann unter "Other" einen Reiter wo dann "Nvidia Quality Upscaling" zu sehen ist. Dieser ist normal auf "OFF" kannst du den mal auf ON machen und mal testen ob die Einstellung bei der Turing etwas bewirkt?

Ich habe es auf meiner Pascal mal getestet und kann keinen Unterschied bei niedrigen Auflösungen erkennen. Wäre interessant ob es bei Turing eine Änderung hervorruft.

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

keine funktion. wenn das ein schalter für DLSS ist, werden wir auf spiele warten müssen, die diese funktion unterstützen.

btw,

meine zweite FE-karte ist jetzt auch verkauft - geht montag in die post.

jetzt habe ich noch eine RTX 2080 Ti von gainward hier liegen.. ein golden samplemit noch 20 tagen rückgabemöglichkeit mit offenem 380W bios und RGB-beleuchtetem fullcover wasserkühler.. geht sehr gut, ist auch seitens der spulen sehr leise und muss sich trotzdem reichlich anstrengen, die titan v zu überholen. mit der karte schaffe ich im SOTTR 68fps wo gv100 auf 69fps kommt.

(..)

mfg

tobi

btw,

meine zweite FE-karte ist jetzt auch verkauft - geht montag in die post.

jetzt habe ich noch eine RTX 2080 Ti von gainward hier liegen.. ein golden sample

(..)

mfg

tobi

Zuletzt bearbeitet:

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

angeregt durch die berichterstattung über abrauchende, also "sterbende" RTX 2080 TIs, habe ich mir das mal ein stündchen mit meiner modifizierten karte angeschaut und sie natürlich akribisch mit dem laser-thermometer abgefahren.

erstmal schaffe ich leidliche bedingungen.. ich heize das wasser und die karte etwas auf..

dann spiele ich far cry 5 @ultra setting, in UHD auflösung mit zusätzlich 150% auflösungsskalierung. dieses setting belegt über 10GiB des VRAM, den ich den schlechten bedingungen zuliebe natürlich mit 8000MHz quäle; eine einstellung übrigens, die mit der FE gar nicht erst möglich gewesen wäre. deren RAM verabschiedete sich schon bei kurz über einem +700er offset.

soderle, jetzt ein bisschen ballern, rumrennen und mit dem gefundenen heli über die pampa

fliegen. der heli bleibt auch etwas in der luft stehen, während ich mit dem thermometer über die karte fahre.. wieder und wieder.. zentimeter für zentimeter..

mit angezeigten 8000MHz bleibt meine backplatelose rückseite an den stellen wo die BGAs sitzen zwischen 43 und 47°C. die heisseste stelle rückseitig gemessen ist hinten rechts. also die ecke der karte, die zum mainboard zeigt und wo offensichtlich die wenigste frischluft ankommt; da gab es 55-57°C.

die GPU ging in diesem gestellten szenario knapp über 50°C hinaus, blieb rückseitig aber 2-5°C kühler.

leider habe ich vor dem umbau verpennt die karte mit stock-cooler zu vermessen, aber ich stelle mal in den raum, dass die temperaturen da mindestens gleichhoch sind, wenn nicht höher. es gab ja auch mal eine backplate, auf deren vorhandensein ich aus überzeugung verzichte.

https://www.tomshw.de/2018/10/30/st...a-rtx-2080-ti-grafikkarten/#mcetoc_1cr2s24jk0

als vergleich, was schlechter gekühlte karten für PCB-temperaturen kreieren, mal ein link zu igor, der mit der wärmebildkamera rückseitig über 80°C auf speicherhöhe misst.

ich denke, ich muss noch nicht alarmiert sein, dass die karte schnell aufgrund schlechter temperaturen ausfällt. ein bisschen vertraue ich natürlich auch auf meine bastelkünste. es gab seit umbau auch kein abnormales verhalten, artefakte, blackscreens oder ähnliches. augenscheinlich ist alles tutti.

(..)

mfg

tobi

erstmal schaffe ich leidliche bedingungen.. ich heize das wasser und die karte etwas auf..

dann spiele ich far cry 5 @ultra setting, in UHD auflösung mit zusätzlich 150% auflösungsskalierung. dieses setting belegt über 10GiB des VRAM, den ich den schlechten bedingungen zuliebe natürlich mit 8000MHz quäle; eine einstellung übrigens, die mit der FE gar nicht erst möglich gewesen wäre. deren RAM verabschiedete sich schon bei kurz über einem +700er offset.

soderle, jetzt ein bisschen ballern, rumrennen und mit dem gefundenen heli über die pampa

fliegen. der heli bleibt auch etwas in der luft stehen, während ich mit dem thermometer über die karte fahre.. wieder und wieder.. zentimeter für zentimeter..

mit angezeigten 8000MHz bleibt meine backplatelose rückseite an den stellen wo die BGAs sitzen zwischen 43 und 47°C. die heisseste stelle rückseitig gemessen ist hinten rechts. also die ecke der karte, die zum mainboard zeigt und wo offensichtlich die wenigste frischluft ankommt; da gab es 55-57°C.

die GPU ging in diesem gestellten szenario knapp über 50°C hinaus, blieb rückseitig aber 2-5°C kühler.

leider habe ich vor dem umbau verpennt die karte mit stock-cooler zu vermessen, aber ich stelle mal in den raum, dass die temperaturen da mindestens gleichhoch sind, wenn nicht höher. es gab ja auch mal eine backplate, auf deren vorhandensein ich aus überzeugung verzichte.

https://www.tomshw.de/2018/10/30/st...a-rtx-2080-ti-grafikkarten/#mcetoc_1cr2s24jk0

als vergleich, was schlechter gekühlte karten für PCB-temperaturen kreieren, mal ein link zu igor, der mit der wärmebildkamera rückseitig über 80°C auf speicherhöhe misst.

ich denke, ich muss noch nicht alarmiert sein, dass die karte schnell aufgrund schlechter temperaturen ausfällt. ein bisschen vertraue ich natürlich auch auf meine bastelkünste. es gab seit umbau auch kein abnormales verhalten, artefakte, blackscreens oder ähnliches. augenscheinlich ist alles tutti.

(..)

mfg

tobi

Zuletzt bearbeitet:

sompe

Grand Admiral Special

- Mitglied seit

- 09.02.2009

- Beiträge

- 15.751

- Renomée

- 2.500

- Mein Laptop

- Dell G5 15 SE 5505 Eclipse Black

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 7800X3D

- Mainboard

- MSI MPG X670E CARBON WIFI

- Kühlung

- Wasserkühlung

- Speicher

- 32GB DDR5-6000 CL36

- Grafikprozessor

- AMD Radeon RX 6900 XT

- Display

- 1x 32" LG 32UD89-W + 1x 24" Dell Ultrasharp 2405FPW

- SSD

- Samsung SSD 980 PRO 1TB, Crucial MX500 500GB, Intel 600p 512GB, Crucial T705 4TB

- HDD

- Western Digital WD Red 2TB, 3TB, 8TB

- Optisches Laufwerk

- LG GGC-H20L

- Soundkarte

- onboard

- Gehäuse

- Thermaltake Armor

- Netzteil

- be quiet! Dark Power Pro 11 1000W

- Betriebssystem

- Windows 10 Professional, Windows 7 Professional 64 Bit, Ubuntu 20.04 LTS

- Webbrowser

- Firefox

Nun ja,das ist eben auch der Vorteil einer wassergekühlten Karte, die Temperatur von deren Komponenten liegt ca. auf dem Niveau des Kühlwassers weil der Speicher und der Spannungswandler hat idR. eine gute Anbindung an den Wasserkühler hat und die Temperaturdifferenz deutlich kleiner ausfällt. Beim Luftkühler wird deren Kühlluft vom GPU Kühler vorgeheizt.....

HalbeHälfte

Vice Admiral Special

- Mitglied seit

- 30.07.2006

- Beiträge

- 674

- Renomée

- 8

Junge was für eine Verarsche... Ich lese mal wieder mit halboffenem Mund und großen Kulleraugen, weil ich denke es wird vergliechen/angeschaut wie sich das auf der TitanV verhält, und merke erst am Ende des Textes und dann bei den Bildern (wohl der Aufregung geschuldet), daß es sich um den 2000er Mülleimer handelt.angeregt durch die berichterstattung [...]

Mann ej

sompe

Grand Admiral Special

- Mitglied seit

- 09.02.2009

- Beiträge

- 15.751

- Renomée

- 2.500

- Mein Laptop

- Dell G5 15 SE 5505 Eclipse Black

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 7800X3D

- Mainboard

- MSI MPG X670E CARBON WIFI

- Kühlung

- Wasserkühlung

- Speicher

- 32GB DDR5-6000 CL36

- Grafikprozessor

- AMD Radeon RX 6900 XT

- Display

- 1x 32" LG 32UD89-W + 1x 24" Dell Ultrasharp 2405FPW

- SSD

- Samsung SSD 980 PRO 1TB, Crucial MX500 500GB, Intel 600p 512GB, Crucial T705 4TB

- HDD

- Western Digital WD Red 2TB, 3TB, 8TB

- Optisches Laufwerk

- LG GGC-H20L

- Soundkarte

- onboard

- Gehäuse

- Thermaltake Armor

- Netzteil

- be quiet! Dark Power Pro 11 1000W

- Betriebssystem

- Windows 10 Professional, Windows 7 Professional 64 Bit, Ubuntu 20.04 LTS

- Webbrowser

- Firefox

Ich behalte die Geschichte auf jeden Fall mit im Auge denne s wäre definitiv interessant woran das offensichtliche Sterben bei der Speicheranbindung liegt. Ist es ein Design Fehler der Karten, der Speicher wird zu heiss udn stirbt dann mit der Zeit den Hitzetot oder schafft der Speicher seine Specs nicht, bzw. hat mit einer hohen Ausfallquote zu kämpfen? Hinzu kommt dann aber auch noch eine weitere Variable die in der Vergangenheit schonmal für ähnliche Probleme sorgte und zum Zeitversetzten Massensterben der GPUs führte, die Qualität der Lötverbindungen des BGAs der GPU. Stichwort: kalte Lötstellen durch zu hartes Lot.

Alyva

Vice Admiral Special

- Mitglied seit

- 12.01.2008

- Beiträge

- 712

- Renomée

- 6

- Details zu meinem Desktop

- Prozessor

- AMD Athlon 64 3500+ Newcastle

- Mainboard

- K8N SLI Platinum

- Kühlung

- Boxed Variante

- Speicher

- MDT 2* 1 GB PC400 CL2

- Grafikprozessor

- Geforce 6800 GT Ultra

- Display

- 17" AOC 1280*1024

- HDD

- WD 360 GD / ST3200822A

- Optisches Laufwerk

- Toshiba DVD-Rom SD-M1912

- Soundkarte

- Soundblaster Audigy

- Netzteil

- 380 Watt

- Betriebssystem

- Windows XP

- Webbrowser

- Maxthon

Sollte der Fehler tatsächlich temperaturabhängig sein, so könnte man tatsächlich mal von teurem Elektroschrott reden. Wäre natürlich traurig wenn es für die TI eine WaKü sein muss für den sicheren Betrieb. Das ist für viele ein NoGo. Für mich sind diese Karten aber so oder so ein Fail und ich hoffe mal auf baldie 7-NM Produkte im sagen wir mal preislich vernünftigen Rahmen für alle. Mal schauen wie sich dieser Fall noch entwickelt.

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

fehler hin oder her.. mal wieder ein bissl was erfreuliches.. hoch aufgelöstes.. tomb raider mit zwei RTX-TIs..

noch'n bissl was in hoch aufgelöstes..

Shadow ot the Tomb Raider

5K

UHD

Far Cry 5

5K

UHD

Unigine Super Position

..schlanke 900W auf dem messgerät.. aber wirklich ziemlich toll.. zumindest da wo es greift.. mGPU

aber das wäre dann die steigerung, die ich ggü. (m)einer einzelnen titan v brauche. schade dass mir von dem schlappen kilowatt schlecht wird.

(..)

mfg

tobi

noch'n bissl was in hoch aufgelöstes..

Shadow ot the Tomb Raider

5K

UHD

Far Cry 5

5K

UHD

Unigine Super Position

..schlanke 900W auf dem messgerät.. aber wirklich ziemlich toll.. zumindest da wo es greift.. mGPU

aber das wäre dann die steigerung, die ich ggü. (m)einer einzelnen titan v brauche. schade dass mir von dem schlappen kilowatt schlecht wird.

(..)

mfg

tobi

Zuletzt bearbeitet:

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

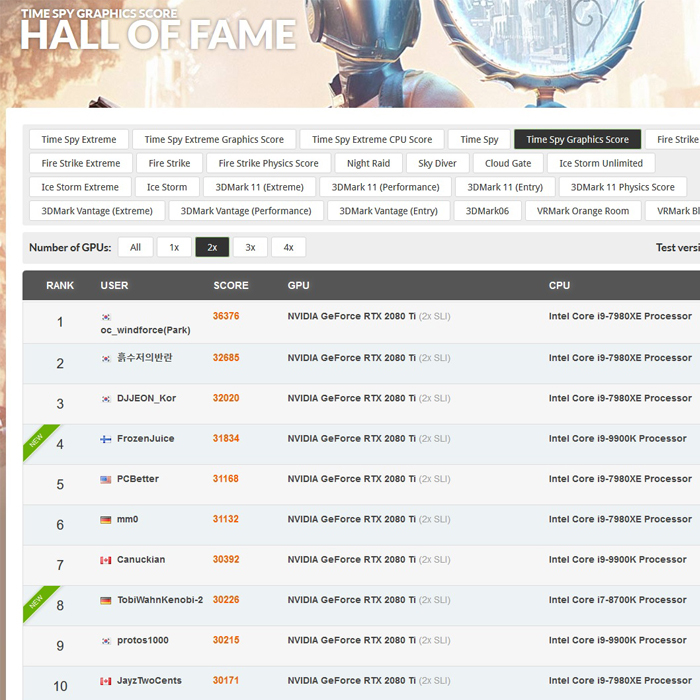

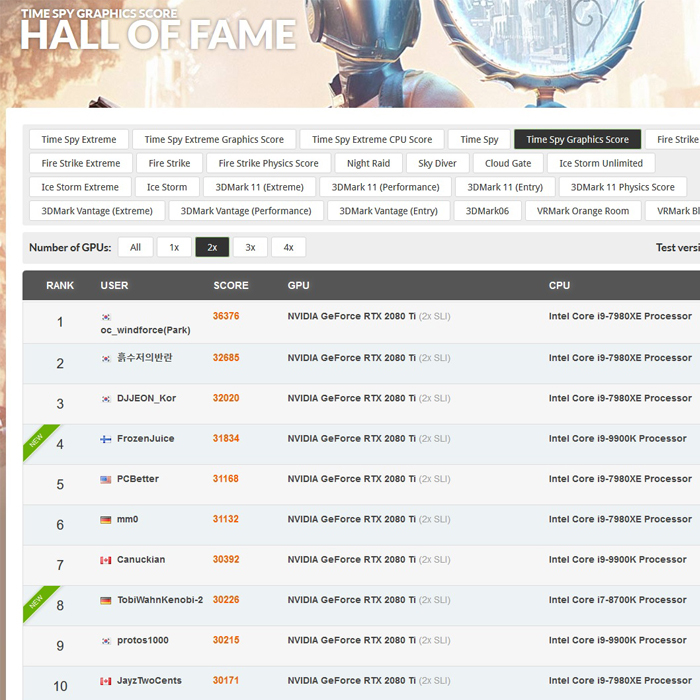

ich hab grad jayztwocents überholt

die leistungsaufnahme ist allerdings jenseits von gut und böse.. das messgerät hat peaks von über 1000W angezeigt.

die HOF war gar nicht mein ziel - ich wollte nur schauen, ob meine bastelei was gebracht hat. ich habe vorhin als ich nach hause kam die KFA²-karte ausgebaut, weil der kleine popelkühler komplett überfordert mit den 380W ist. das kaut einem die ohren ab, macht angst weil die karte glüht und ist in anbetracht der munkelei von ausfallenden karten ein äußert beunruhigender zustand. dabei habe ich dann festgestellt, dass die backplate nur zierde ist und beschlossen, dass ich das kühlsystem nicht weiter verwenden werde. leider sind in meinem fundus passende wasserkühler rar gesäht um nicht zu sagen, gar nicht vorhanden. AAAABER: hier poltert ja noch der triplefan kühler von der gainwardkarte rum.. der wohnt jetzt samt mit WLpads ausgestatteter backplate auf der KFA² - und schon macht die karte spaß.. beide (die wassergekühlte gayward und die luftgekühlte KFA²) starten mit etwas über 2.1GHz und brechen dann irgendwann auf 2.085/2.070MHz runter. verglichen mit dem dualfan-kühlerchen ist sogar die tonlage absolut alltagstauglich; auf meine untere karte muss erstmal kein wasserkühler. äusserst erleichternd, wie ich finde, denn dann muss ich auch den vorhandenen kreislauf nicht weiter mit wärmequellen belasten (ich kühle komplett mit internen radiatoren).

btw,

der kühler verhält sich auf der anderen "richtigen" nvidia-referenzkarte genauso wie auf dem lizenzbau-PCB der gainward; also er passt, alle lüfter drehen, sind regelbar und beleuchtet. von nervenschonen bis farbwechsel funzt alles.. nur halt leider mit über 1000W, wenn man anständig taktet und das kann ich nicht dauerhaft mit meinem gewissen vereinbaren.. mein NT hat "nur" 850W.

(..)

mfg

tobi

die leistungsaufnahme ist allerdings jenseits von gut und böse.. das messgerät hat peaks von über 1000W angezeigt.

die HOF war gar nicht mein ziel - ich wollte nur schauen, ob meine bastelei was gebracht hat. ich habe vorhin als ich nach hause kam die KFA²-karte ausgebaut, weil der kleine popelkühler komplett überfordert mit den 380W ist. das kaut einem die ohren ab, macht angst weil die karte glüht und ist in anbetracht der munkelei von ausfallenden karten ein äußert beunruhigender zustand. dabei habe ich dann festgestellt, dass die backplate nur zierde ist und beschlossen, dass ich das kühlsystem nicht weiter verwenden werde. leider sind in meinem fundus passende wasserkühler rar gesäht um nicht zu sagen, gar nicht vorhanden. AAAABER: hier poltert ja noch der triplefan kühler von der gainwardkarte rum.. der wohnt jetzt samt mit WLpads ausgestatteter backplate auf der KFA² - und schon macht die karte spaß.. beide (die wassergekühlte gayward und die luftgekühlte KFA²) starten mit etwas über 2.1GHz und brechen dann irgendwann auf 2.085/2.070MHz runter. verglichen mit dem dualfan-kühlerchen ist sogar die tonlage absolut alltagstauglich; auf meine untere karte muss erstmal kein wasserkühler. äusserst erleichternd, wie ich finde, denn dann muss ich auch den vorhandenen kreislauf nicht weiter mit wärmequellen belasten (ich kühle komplett mit internen radiatoren).

btw,

der kühler verhält sich auf der anderen "richtigen" nvidia-referenzkarte genauso wie auf dem lizenzbau-PCB der gainward; also er passt, alle lüfter drehen, sind regelbar und beleuchtet. von nervenschonen bis farbwechsel funzt alles.. nur halt leider mit über 1000W, wenn man anständig taktet und das kann ich nicht dauerhaft mit meinem gewissen vereinbaren.. mein NT hat "nur" 850W.

(..)

mfg

tobi

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

vor dem netzteil an der steckdose.

(..)

mfg

tobi

(..)

mfg

tobi

Zuletzt bearbeitet:

Alyva

Vice Admiral Special

- Mitglied seit

- 12.01.2008

- Beiträge

- 712

- Renomée

- 6

- Details zu meinem Desktop

- Prozessor

- AMD Athlon 64 3500+ Newcastle

- Mainboard

- K8N SLI Platinum

- Kühlung

- Boxed Variante

- Speicher

- MDT 2* 1 GB PC400 CL2

- Grafikprozessor

- Geforce 6800 GT Ultra

- Display

- 17" AOC 1280*1024

- HDD

- WD 360 GD / ST3200822A

- Optisches Laufwerk

- Toshiba DVD-Rom SD-M1912

- Soundkarte

- Soundblaster Audigy

- Netzteil

- 380 Watt

- Betriebssystem

- Windows XP

- Webbrowser

- Maxthon

Leider wird auch in 7 nm die Leistung der Singlekarte nicht an SLI heran kommen. Aber gut 35% für die Karte an Mehrleistung dürfte locker drin sein. Außer sie legen mehr Wert auf Effizienz. Aber das sind halt noch ungelegte Eier

Casi030

Grand Admiral Special

- Mitglied seit

- 03.10.2012

- Beiträge

- 8.847

- Renomée

- 152

OK,bei rund 10% und 1000Watt wärst so bei 900 gelandet,aber bei 1063 sind es dann schon wieder 957Watt.......Ich denke mal in voller CPU und GPU Last dürft es noch höher gehen.

Da kannst langsam aufrüsten.

https://geizhals.de/corsair-professional-series-hx1200i-1200w-atx-2-4-cp-9020070-eu-a1215556.html

Da kannst langsam aufrüsten.

https://geizhals.de/corsair-professional-series-hx1200i-1200w-atx-2-4-cp-9020070-eu-a1215556.html

sompe

Grand Admiral Special

- Mitglied seit

- 09.02.2009

- Beiträge

- 15.751

- Renomée

- 2.500

- Mein Laptop

- Dell G5 15 SE 5505 Eclipse Black

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 7800X3D

- Mainboard

- MSI MPG X670E CARBON WIFI

- Kühlung

- Wasserkühlung

- Speicher

- 32GB DDR5-6000 CL36

- Grafikprozessor

- AMD Radeon RX 6900 XT

- Display

- 1x 32" LG 32UD89-W + 1x 24" Dell Ultrasharp 2405FPW

- SSD

- Samsung SSD 980 PRO 1TB, Crucial MX500 500GB, Intel 600p 512GB, Crucial T705 4TB

- HDD

- Western Digital WD Red 2TB, 3TB, 8TB

- Optisches Laufwerk

- LG GGC-H20L

- Soundkarte

- onboard

- Gehäuse

- Thermaltake Armor

- Netzteil

- be quiet! Dark Power Pro 11 1000W

- Betriebssystem

- Windows 10 Professional, Windows 7 Professional 64 Bit, Ubuntu 20.04 LTS

- Webbrowser

- Firefox

@ TobiWahnKenobi

Um die 1000W an der Steckdose? Geht ja noch...

Um die 1000W an der Steckdose? Geht ja noch...

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

das ist echt mies

star wars battlefront, UHD, voll aufgerotzt, system auf 1000 watt -> 200fps

star wars battlefront, UHD, voll aufgerotzt, +200% auflösungsskalierung -> system schaltet ab!!

(..)

mfg

tobi

star wars battlefront, UHD, voll aufgerotzt, system auf 1000 watt -> 200fps

star wars battlefront, UHD, voll aufgerotzt, +200% auflösungsskalierung -> system schaltet ab!!

(..)

mfg

tobi

sompe

Grand Admiral Special

- Mitglied seit

- 09.02.2009

- Beiträge

- 15.751

- Renomée

- 2.500

- Mein Laptop

- Dell G5 15 SE 5505 Eclipse Black

- Details zu meinem Desktop

- Prozessor

- AMD Ryzen 7 7800X3D

- Mainboard

- MSI MPG X670E CARBON WIFI

- Kühlung

- Wasserkühlung

- Speicher

- 32GB DDR5-6000 CL36

- Grafikprozessor

- AMD Radeon RX 6900 XT

- Display

- 1x 32" LG 32UD89-W + 1x 24" Dell Ultrasharp 2405FPW

- SSD

- Samsung SSD 980 PRO 1TB, Crucial MX500 500GB, Intel 600p 512GB, Crucial T705 4TB

- HDD

- Western Digital WD Red 2TB, 3TB, 8TB

- Optisches Laufwerk

- LG GGC-H20L

- Soundkarte

- onboard

- Gehäuse

- Thermaltake Armor

- Netzteil

- be quiet! Dark Power Pro 11 1000W

- Betriebssystem

- Windows 10 Professional, Windows 7 Professional 64 Bit, Ubuntu 20.04 LTS

- Webbrowser

- Firefox

@TobiWahnKenobi

Hehehe, was nutzt du nochmal für ein Netzteil?

Bei meinen Seasonic Platinum Netzteilen hatte ich immer das Problem das diese sich, vermutlich wegen Lastspitzen, zu schnell abschalteten und ich sie deshalb teils massiv überdimensionieren musste.

Hehehe, was nutzt du nochmal für ein Netzteil?

Bei meinen Seasonic Platinum Netzteilen hatte ich immer das Problem das diese sich, vermutlich wegen Lastspitzen, zu schnell abschalteten und ich sie deshalb teils massiv überdimensionieren musste.

bschicht86

Redaktion

☆☆☆☆☆☆

- Mitglied seit

- 14.12.2006

- Beiträge

- 4.250

- Renomée

- 234

- BOINC-Statistiken

- Details zu meinem Desktop

- Prozessor

- 2950X

- Mainboard

- X399 Taichi

- Kühlung

- Heatkiller IV Pure Chopper

- Speicher

- 64GB 3466 CL16

- Grafikprozessor

- 2x Vega 64 @Heatkiller

- Display

- Asus VG248QE

- SSD

- PM981, SM951, ein paar MX500 (~5,3TB)

- HDD

- -

- Optisches Laufwerk

- 1x BH16NS55 mit UHD-BD-Mod

- Soundkarte

- Audigy X-Fi Titanium Fatal1ty Pro

- Gehäuse

- Chieftec

- Netzteil

- Antec HCP-850 Platinum

- Betriebssystem

- Win7 x64, Win10 x64

- Webbrowser

- Firefox

- Verschiedenes

- LS120 mit umgebastelten USB -> IDE (Format wie die gängigen SATA -> IDE)

Zumindest erstaunlich, was das Netzteil noch an Reserven hat. Bin mal gespannt, ob nVidia mit der nächsten Gen wieder soviel Leistung drauflegt. Die müssen ja erstmal wieder das Stromsparen lernen.

TobiWahnKenobi

Grand Admiral Special

★ Themenstarter ★

- Mitglied seit

- 11.08.2004

- Beiträge

- 7.035

- Renomée

- 164

- Standort

- Hannover

- Mein Laptop

- Macbook Pro 13" Retina BTO /i7

- Details zu meinem Desktop

- Prozessor

- Intel Core i9 14900K

- Mainboard

- Z790 (Asrock)

- Kühlung

- H2O

- Speicher

- 48GB DDR5 7800 (38-42-42-42-116)

- Grafikprozessor

- 32GiB NVidia Geforce RTX 5090

- Display

- 55" LG OLED C9 | 140" Acer DLP-3D

- SSD

- 8TB NVMe RAID + 16TB SSD RAID + 2TB System M2 + 4TB SATA SSD

- HDD

- 36TB

- Optisches Laufwerk

- Bluray RW

- Soundkarte

- HDMI (Dolby Atmos @Yamaha AVR 5.2.2) / ALC / Hercules DJ Instinct Mixer

- Gehäuse

- Thermal Take Core X71

- Netzteil

- 1200W Corsair HXi

- Tastatur

- Corsair K68 und originale von Cherry

- Maus

- Logitech G502

- Betriebssystem

- Windows 11 24H2

- Webbrowser

- Firefox

- Verschiedenes

- DVB-C, x10 Remote, XBox-Elite-Pad, Grafiktablet, Pioneer DDJ SB2, iP2500, Fritzbox, Meta VR, Arcadesticks und Hitboxen

ja, dass das verbaute NT so stabil über seine nennbelastbarkeit hinausgeht hat mich auch überrascht. wenn ich die karte nicht an die grenzen ihres powerlimits belaste, komme ich sogar ganz passabel mit dem saft hin. das würde ich allerdings niemandem empfehlen, der nicht wie ich ein leistungsmessgerät in der zuleitung hängen hat. anyway, nichts-desto-trotz werde ich das RM850i wohl zeitnah ersetzen. schade eigentlich - ist ein geiles teil und viel zu schade für die grabbelkiste; es ist nichtmal alt. wenn ich das aus casis link nehme kann ich alle kabel so liegenlassen und muss nur das NT austauschen. das anschlussfeld sieht identisch aus. komplette NT-wechsel mit neuverkabelung empfinde ich als nervig, weil das X71 (mein gehäuse) im unteren bereich wo das NT sitzt einen großteil der wakü verbaut hat. die schläuche sind nicht übermäßig lang und der querverbauten tripleradi muss für einen NT-wechsel raus. bin damals beim verschlauchen nicht auf die idee gekommen, je mehr als 850W zu benötigen. immerhin hat das in der vergangenheit immer für mGPU-spielchen gereicht. von kepler über maxwell bis pascal hatte ich immer "nur" 850W PSUs.

wahrscheinlich würde es für karten mit normalen von nvidia spezifizierten powerlimits (250-320W?) sogar reichen, aber die KFA² habe ich ja vorsätzlich gekauft, weil sie werkseitig mit 300-380W daherkommt und trotz referenzlayout ohne verrenkungen flashbar ist. das ist bios-seitig die spitze unter den referenzkarten, nur ist die kühlung müll. die gainward musste ich noch mit einer gemoddeten nvflash-version und nach entfernen des schreibschutzes auf 380W hochflashen. auf beiden karten ist jetzt ein KFA²/GALAX bios; das auf der luftgekühlten karte ist etwas neuer..

(..)

mfg

tobi

wahrscheinlich würde es für karten mit normalen von nvidia spezifizierten powerlimits (250-320W?) sogar reichen, aber die KFA² habe ich ja vorsätzlich gekauft, weil sie werkseitig mit 300-380W daherkommt und trotz referenzlayout ohne verrenkungen flashbar ist. das ist bios-seitig die spitze unter den referenzkarten, nur ist die kühlung müll. die gainward musste ich noch mit einer gemoddeten nvflash-version und nach entfernen des schreibschutzes auf 380W hochflashen. auf beiden karten ist jetzt ein KFA²/GALAX bios; das auf der luftgekühlten karte ist etwas neuer..

(..)

mfg

tobi

Ähnliche Themen

- Antworten

- 623

- Aufrufe

- 57K

- Antworten

- 2K

- Aufrufe

- 130K

- Antworten

- 680

- Aufrufe

- 94K

- Antworten

- 505

- Aufrufe

- 59K